热门标签

热门文章

- 1计算机右击管理在哪,电脑权限管理在哪里

- 2LoRaWAN协议-Class A类设备分析_lorawan classa

- 3机器学习概述及其主要算法_哪些属于机器学习

- 4《数据挖掘导论》 - 读书笔记(3) - 数据 [2016-8-13]

- 5【Python】已完美解决:(Python键盘中断报错问题) KeyboardInterrupt

- 6用Kafka自带脚本实现Kafka消费情况实时监控

- 7蓝桥杯C_C++/Java程序设计常用算法&技巧总结_蓝桥杯c语言算法入门

- 8企业级负载均衡解决方案之十:微软Azure公有云负载均衡系统Ananta_microsoft提出了ananta

- 9zk Linux下的启动常用命令_linux. zk. 重启

- 10bat程序黑客帝国数字雨_黑客代码文本文档bat

当前位置: article > 正文

本地部署开源大模型的完整教程:LangChain + Streamlit+ Llama_开源大模型本地部署

作者:繁依Fanyi0 | 2024-06-22 13:49:19

赞

踩

开源大模型本地部署

在过去的几个月里,大型语言模型(llm)获得了极大的关注,这些模型创造了令人兴奋的前景,特别是对于从事聊天机器人、个人助理和内容创作的开发人员。

大型语言模型(llm)是指能够生成与人类语言非常相似的文本并以自然方式理解提示的机器学习模型。这些模型使用广泛的数据集进行训练,这些数据集包括书籍、文章、网站和其他来源。通过分析数据中的统计模式,LLM可以预测给定输入后最可能出现的单词或短语。

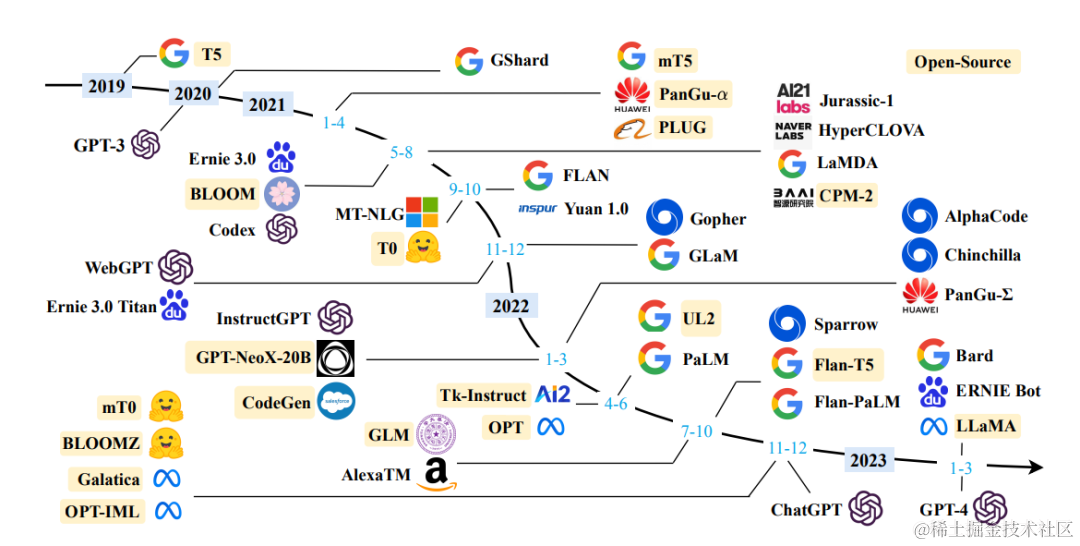

目前的LLM的一个全景图

在本文中,我将演示如何利用LLaMA 7b和Langchain从头开始创建自己的Document Assistant。

背景知识

在这篇文章中,我将展示从头开始创建自己的文档助手的过程,利用LLaMA 7b和Langchain,一个专门为与LLM无缝集成而开发的开源库。

以下是该博客的结构概述,概述了具体的章节,将详细介绍该过程:

- 设置虚拟环境和创建文件结构。

- 在你的本地机器上设置LLM。

- 将LLM与LangChain整合并定制PromptTemplate。

- 文件检索和答案生成。

- 使用Streamlit建立应用程序。

1、LangChain 声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/繁依Fanyi0/article/detail/746684

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/繁依Fanyi0/article/detail/746684

推荐阅读

相关标签

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。