热门标签

热门文章

- 1CentOS7部署双节点OpenStack_如何安装openstack双节点

- 2MySql 执行事务无效无法回滚问题_mysql 服务端插入数据事务回滚不生效

- 3Android11上实现独立切换MIC和扬声器_android mic

- 4《黑马头条》 内容安全 自动审核 feign 延迟任务精准发布 kafka

- 5Realsense 相机SDK学习(一)——librealsense使用方法及bug解决(不使用Ros)

- 6chrome去除下载警告和设置下载目录方法

- 7MySQL新建匿名用户_初始化MySQL用户(删除匿名用户)

- 8通过把场景打包长AB包然后加载。场景之中的光照贴图没用的问题_urp 光照贴图 ab包

- 9OpenResty 连接Redis_openresty redis

- 10Python 3.12.4下载与安装_python3.12.4下载

当前位置: article > 正文

从huggingface下载模型像本地加载但是UnicodeDecodeError_huggingface unicodedecodeerror

作者:黑客灵魂 | 2024-08-07 14:42:49

赞

踩

huggingface unicodedecodeerror

我自己是在Linux下出现了这个问题

解决

加入local_files_only=True。参考官方:https://huggingface.co/docs/transformers/installation#offline-mode

另外要注意

原文:https://github.com/huggingface/transformers/issues/13674

The path for the AutoModel should be to a directory pointing to a pytorch_model.bin and to a config.json. Since you’re pointing to the .bin file directly, the configuration cannot be loaded.

也就是除了model文件之外,还要有一个config.json文件在旁边,2个是要一起的。有一些不光要config.json,还有其他的文件,多下点,都放上。

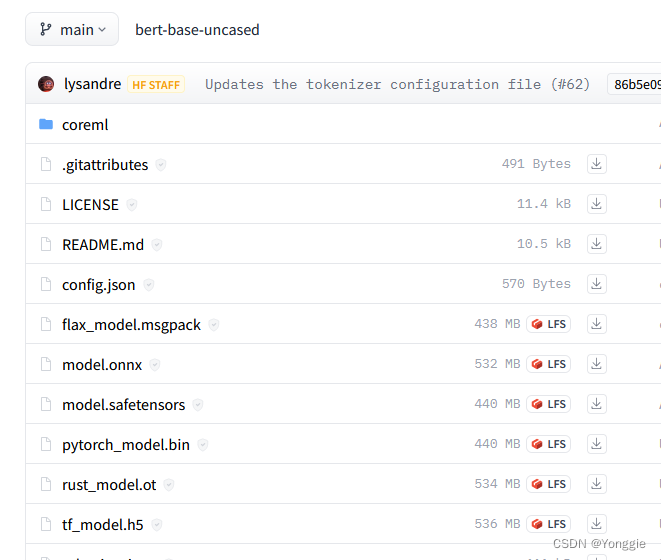

下面的config.json和符合框架的model文件。

总结

把所有的文件下砸完之后,再在from pretrain里面加上··local_files_only=True:

model = xxx.from_pretrained("./path/to/local/directory", local_files_only=True)

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/黑客灵魂/article/detail/943031

推荐阅读

相关标签