热门标签

热门文章

- 1BiLSTM+CRF医学病例命名实体识别项目

- 2matlab for hold 画图,我用matlab写的程序为什么画图不能全部显示?for i=1:5\x05line([0,50],[i,i]);endaxis equalaxis off%画符干...

- 3C# FileToStream 文件转换成文件流_c# ifromfile转stream

- 4对不同的人说不同的话的职场口才分享_对不同的人说不同的人

- 5大模型日报-20240104_justine tunney

- 6华为Could API人工智能系列——自然语言处理——属性级情感分析

- 7图像检索(含代码)_用代码实现搜索用户及结果图

- 8Hadoop和Hbase版本对应关系(参考官网)_hadoop hbase 对应

- 9程序员:在这技术更新如此快的时代,注意别因学太多而被压垮了_程序员 学习量太大

- 10【黑马-SpringCloud技术栈】【02】服务拆分及远程调用_服务提供者与消费者_黑马程序员springcloud

当前位置: article > 正文

Transformer的前世今生 day08(Positional Encoding)

作者:Monodyee | 2024-03-30 06:06:10

赞

踩

Transformer的前世今生 day08(Positional Encoding)

前情提要

- Attention的优点:解决了长序列依赖问题,可以并行。Attention的缺点:开销变大了,而且不存在位置关系

- 为了解决Attention中不存在位置关系的缺点,我们通过位置编码的形式加上位置关系

Positional Encoding(位置编码)

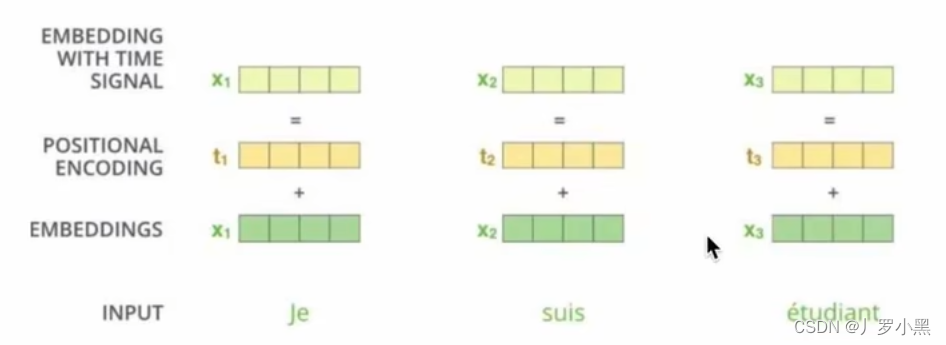

- 通过在原输入词向量的基础上,给他加一个位置编码,组成新的输入词向量

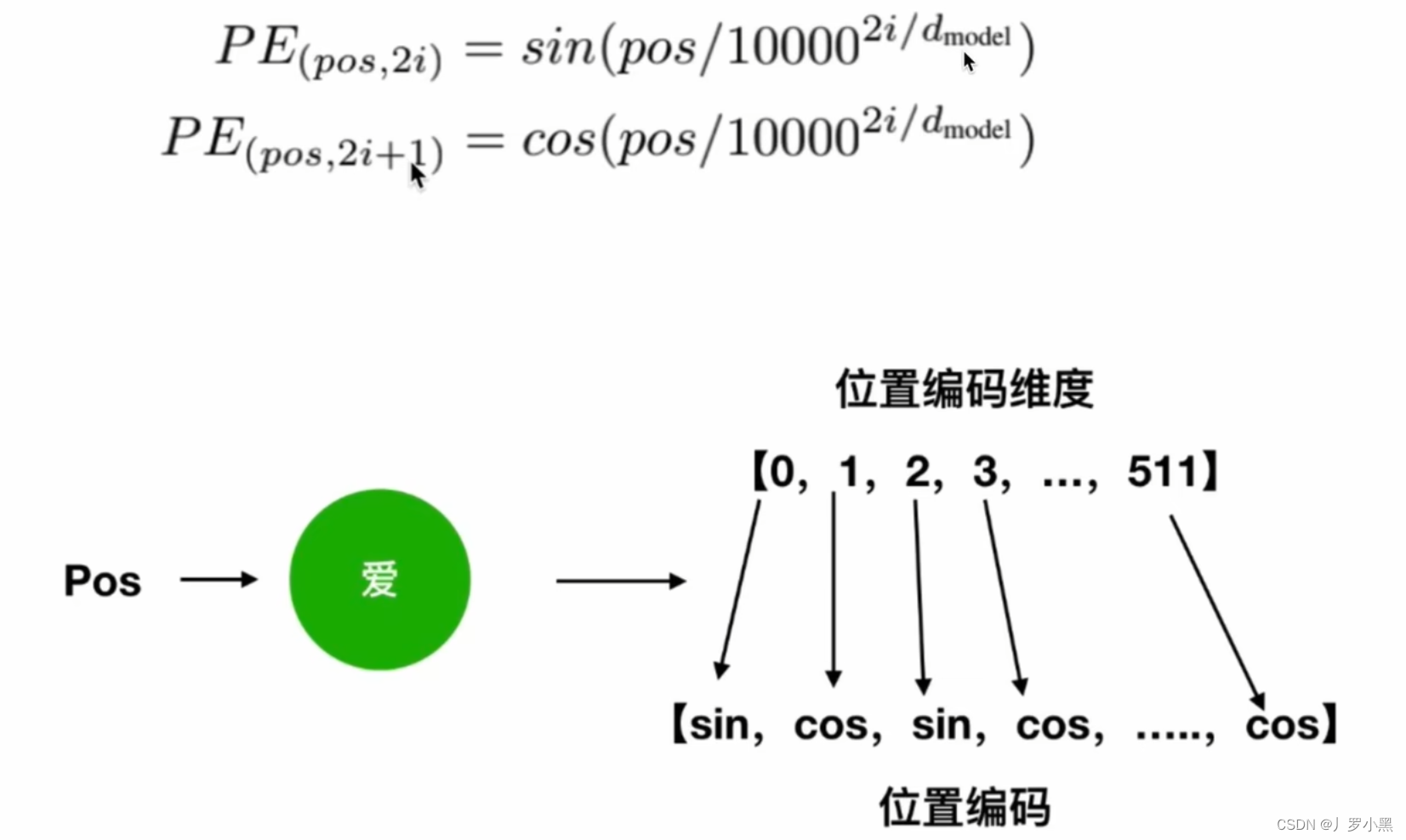

- 位置编码的具体公式,如下:

- 其中:pos指当前单词在句子中的位置,i指位置编码维度的第几维(通常来说词向量的维度为512,那么i就是0-511,表示第几维)

- 所以,对于某个词的位置编码,偶数维度用了sin函数,奇数维度用了cos函数

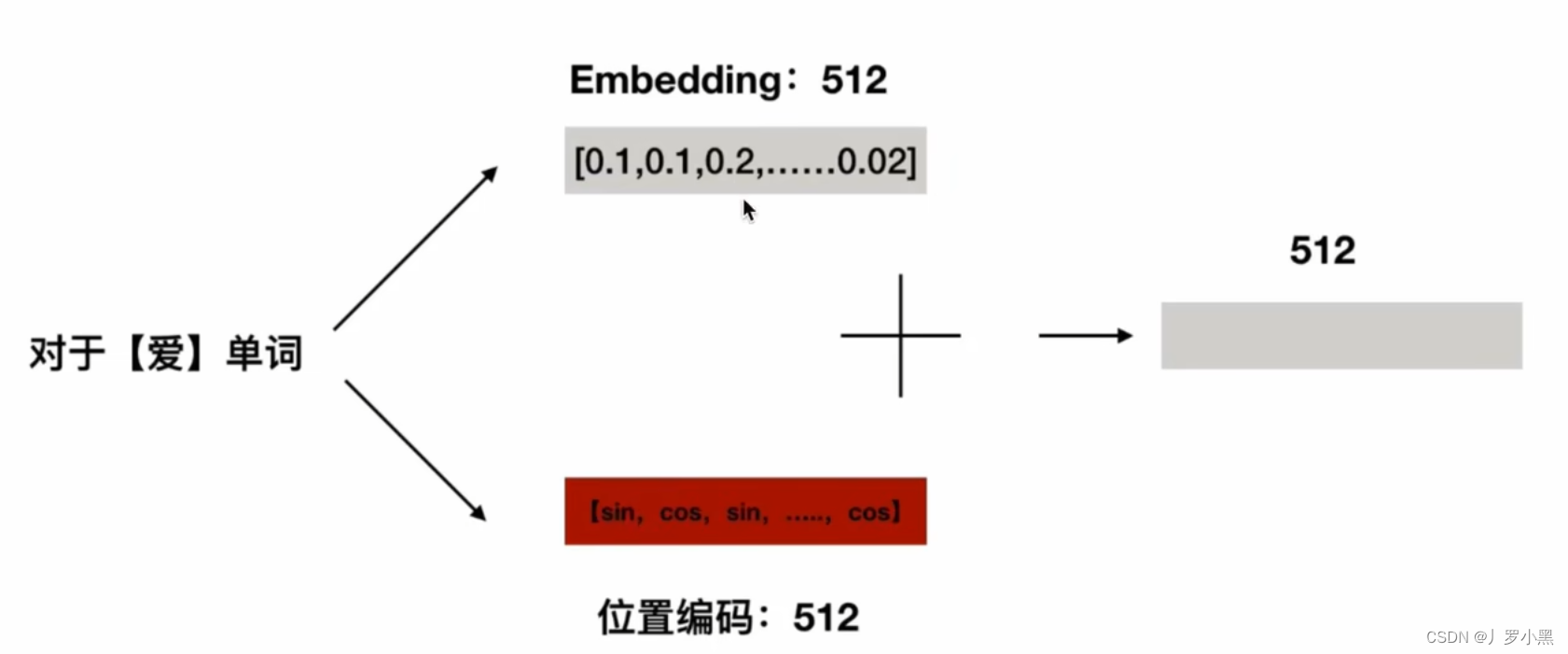

- 得到位置编码后,与输入词向量X叠加后,得到新的输入词向量X’

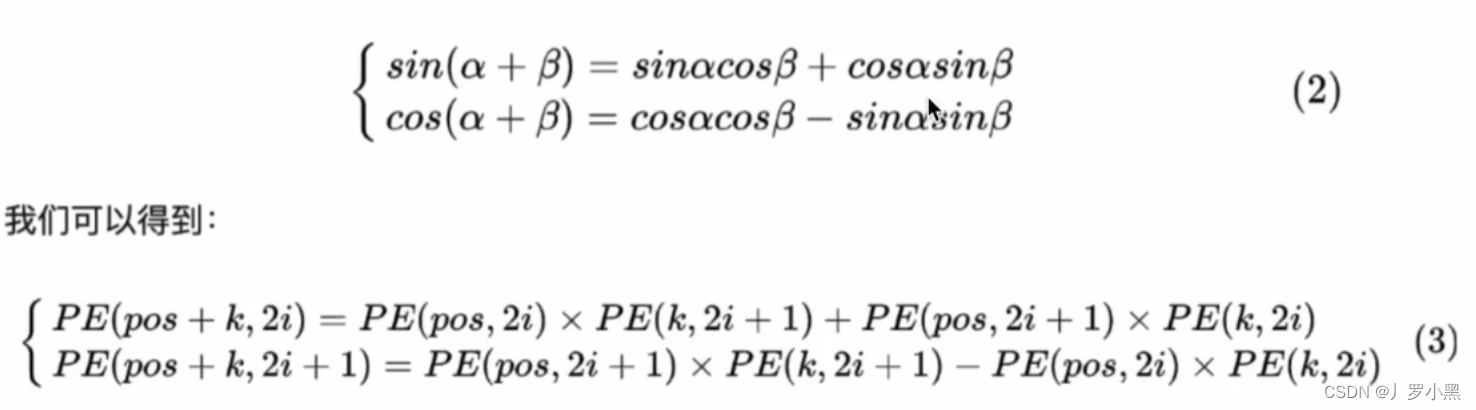

- 由于sin和cos函数有以下公式,那么我们可以得到某一个位置的位置编码和其他两个位置的位置编码之间的关系,如下:

- 所以,当我们使用位置编码的这个函数时,对于pos+k位置的位置向量某一维2i或2i+1而言,可以表示为,pos位置与k位置的位置向量2i和2i+1的线性组合,而这个线性组合意味着pos+k的位置向量中蕴含了pos位置和k位置的位置信息

- 而且这个位置编码的位置信息具有独特性,会随着我们输入句子的顺序改变而发生改变,比如“我爱你”中的你的位置编码,和“你爱我”中的你的位置编码所蕴含的位置信息就不同

参考文献

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/Monodyee/article/detail/339380

推荐阅读

相关标签