- 1深度学习(11)之Anchor-Free详解

- 2算法训练营第六十九天 | 并查集理论基础、寻找存在的路径、冗余连接、冗余连接II_卡码网

- 3Git常用命令大全_git rename

- 4弹出框 custombox.min.js 使用时候由于滚动条隐藏造成网页抖动变形的解决办法

- 5【前端系列】20种 Button 样式_前端按钮

- 6uniapp:完成商品分类页面(scroll-view),左侧导航,右侧商品_uniapp左侧导航右侧内容

- 7深度学习实战—基于TensorFlow 2.0的人工智能开发应用_深度学习实战:基于tensorflow

- 8QT网络编程之实现TCP客户端和服务端_qt tcp客户端

- 9哈工大(HIT)计算机网络 翻转课堂 实验 mooc答案 总结_哈工大计网mooc答案

- 10Stable Diffusion学习笔记_马尔科夫链的反向过程是

【风格迁移】CAST:对比学习,从图像特征而非其二阶统计量(Gram矩阵)中学习风格_cast风格迁移

赞

踩

提出背景

论文:https://arxiv.org/pdf/2205.09542.pdf

代码:https://github.com/zyxElsa/CAST_pytorch.

面对任意图像风格转换的问题,错误的认知是仅仅依赖于传统的深度学习方法和二阶统计量(如Gram矩阵)足以实现高质量的风格迁移。

然而,这种方法往往忽略了风格的复杂性和多样性,导致风格不一致和局部失真的问题。

5 why 分析

Why 1: 为什么需要捕获并转移艺术图像的局部笔触特征和整体外观?

- 因为艺术风格的细节和整体感觉对于风格化图像的视觉冲击和艺术表现至关重要。

Why 2: 这些特征为什么难以捕获和转移?

- 传统风格转换方法可能无法充分理解和复现艺术作品的深层风格特征和复杂的视觉模式。

Why 3: 为什么传统方法无法充分理解和复现这些特征?

- 传统方法可能过于依赖全局特征的统计数据,而没有考虑到局部细节和多层次的风格表示。

Why 4: 为什么会过于依赖这些统计数据?

- 以前的研究可能没有充分利用深度学习和对比学习等现代技术来提取更丰富的特征表示。

Why 5: 最根本的原因是什么?

- 缺乏一个综合性框架来利用多层次风格特征,并通过对比学习优化这些特征的表示和转移。

5 so分析

So 1: 因此,我们可以怎样解决或改进?

- 我们可以开发一个包含多层次风格投影器的框架,该框架可以编码不同层次的风格细节。

So 2: 这个解决方案或改进会带来什么结果?

- 这将使我们能够更精确地捕获和表达艺术图像的风格,从而在风格转移时保留更多细节。

So 3: 这个结果会如何影响整个系统或过程?

- 通过提高风格转移的精确度,我们可以生成更具吸引力和艺术性的风格化图像,提升用户体验。

So 4: 进一步的影响是什么?

- 增强的用户体验和高质量的风格化图像将推动艺术风格转换技术在设计、娱乐和教育等领域的应用。

So 5: 最终,我们希望达到什么目标或状态?

- 我们希望开发出一种高效的、可扩展的任意风格转换技术,它能够广泛应用于各种不同的艺术风格,并被广泛用于实际应用和研究。

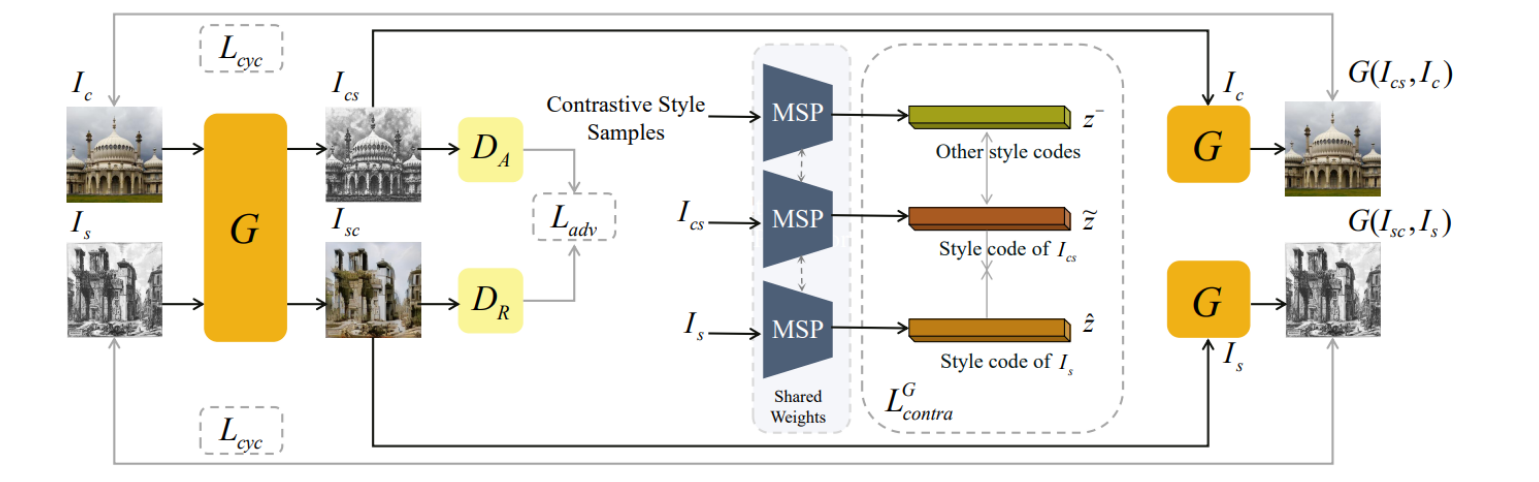

CAST 框架

基于编码器-变换器-解码器的生成器(G)、多层风格投影器(MSP)模块和领域增强模块组成。

描述了流程,包括如何将内容(I_c)和风格(I_s)图像输入到MSP模块生成风格代码,这些代码随后用于风格对比学习过程。

还显示了用于对抗性训练和循环一致性训练的鉴别器(D_A和D_R),这是生成对抗网络(GANs)中典型的组件。

CAST = 特征1 (多层风格投影器) + 特征2 (领域增强模块) + 特征3 (生成网络)

开始于风格特征的精确提取(多层风格投影器),接着通过(领域增强模块)对这些特征进行分析和增强,最后通过(生成网络)实现风格的应用和转换。

“多层风格投影器”、“领域增强模块”和“生成网络”的设计背后是,对比学习和利用全面的视觉特征:

-

引入对比学习:

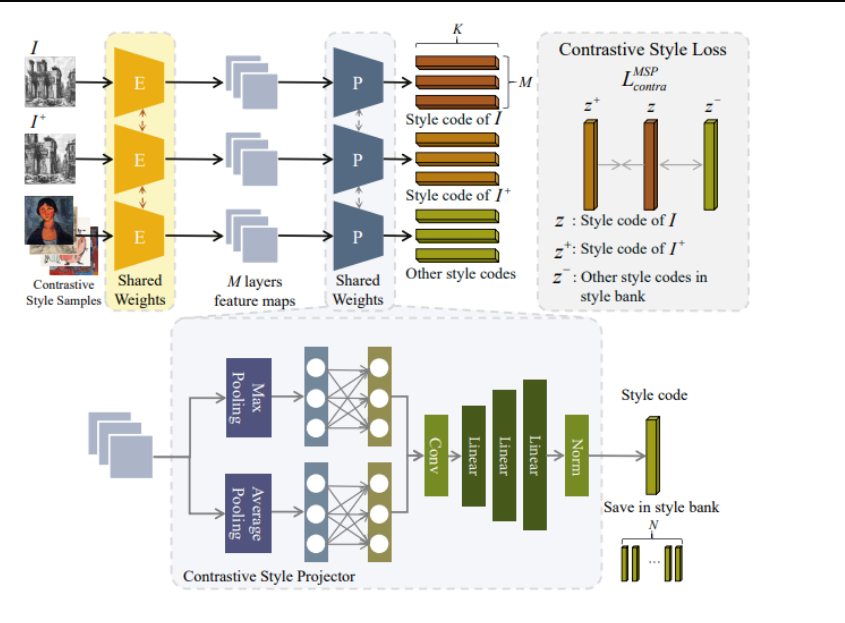

- 多层风格投影器:在这个阶段,对比学习帮助模型识别和编码来自不同风格源的独特视觉特征。通过对比不同风格之间的特征,模型能够更准确地提取和编码风格表示,从而捕捉风格的细微差异。

- 领域增强模块:利用对比学习进一步细化风格表示,确保模型能够处理风格之间的多样性和复杂性,从而增强风格转换的一致性和准确性。

- 生成网络:在生成过程中,对比学习方法可以帮助模型更好地匹配风格特征和内容特征,避免在风格迁移时产生失真或不自然的效果。

-

利用全面的视觉特征:

- 在整个风格转换框架中,从多层风格投影器到生成网络的每一步,都依赖于对全面视觉特征的深入分析和应用。

这包括不仅仅是浅层的纹理和颜色特征,也包括深层的形状和结构特征,以及它们在不同风格中的变化。

多层风格投影器

举个例子,将一张普通照片转换为具有梵高《星夜》风格的图像:

-

多层风格投影器:首先,系统利用对比学习从《星夜》和原始照片中提取风格和内容特征。

这一步骤不仅捕捉了《星夜》的颜色和纹理,还识别了其特有的笔触和动态效果。

- 特征1:深度特征提取和编码,用于捕获风格图像和内容图像的高层次特征。

- 特征2: 对比学习在特征编码中的应用,用于强化风格特征的区分度和表达力。

- 原因: 选择深度特征提取是因为任意风格转换需要理解图像的高级语义信息;选择对比学习是因为它能够通过比较不同图像间的特征差异,有效地学习风格特征的独特性。

领域增强模块

-

领域增强模块:随后,通过分析《星夜》的风格特征与普通照片风格特征之间的对比,领域增强模块进一步优化风格表示。

这确保了风格转换能够适应从一个领域到另一个领域的细微差别,增强了风格迁移的自然度和一致性。

- 特征3: 风格与内容特征之间对比度的增强,用于提升风格迁移的一致性和自然度。

- 特征4: 领域适应性学习,用于处理多样化的风格转换任务。

- 原因: 通过增强风格和内容特征的对比度来优化风格表示,是为了确保转换后的图像在风格上的准确性和视觉效果的自然性;领域适应性学习是因为不同的风格转换任务可能需要模型对不同风格和内容的灵活适应。

生成网络

-

生成网络:最后,利用优化后的风格表示,生成网络将《星夜》的风格应用到原始照片上,生成最终的风格迁移图像。

在这一步,全面的视觉特征和对比学习共同作用,确保最终图像既保留了原图的结构,又成功捕捉了目标风格的精髓。

- 特征5: 结构与风格的融合技术,用于在保持内容图像结构的同时引入目标风格。

- 特征6: 对比学习和全面视觉特征在生成阶段的综合应用,确保风格的准确迁移和视觉效果的自然性。

- 原因: 结构与风格的融合是为了保证风格迁移后图像既有高度的艺术性,又不失去原图的识别度;综合应用对比学习和全面视觉特征于生成阶段是为了充分利用学习到的风格表示,实现高质量的风格转换效果。

效果

相比其他方法,CAST能够更好地保留局部细节和整体风格感,避免了如NST方法可能出现的不愉快的局部最小值问题,也避免了AdaIN可能产生的不清晰细节和不希望的模式。

对比 StyleGAN

CAST(Contrastive Arbitrary Style Transfer)算法和StyleGAN在风格迁移上采用了不同的方法和目标。以下是两者之间的一些关键对比点:

CAST算法

- 目标:CAST旨在任意图像之间转移风格,特别强调在风格迁移过程中保持内容图像的结构。

- 方法:它采用多层风格投影器(MSP)来编码图像的风格特征,并通过对比学习来优化这些特征的表示。

- 风格表示:使用多层网络提取的特征映射到风格代码,以更细粒度地捕获风格细节。

- 对比学习:使用对比学习来区分不同风格,而不是直接复制风格源的细节。

- 优势:CAST能够灵活地表示生动的局部笔触特征和整体外观,同时还保持了内容结构,这对于艺术风格转移尤其重要。

StyleGAN

- 目标:StyleGAN主要用于生成高质量的新图像,它通过风格化噪声和映射网络来控制图像生成的不同方面。

- 方法:StyleGAN使用生成对抗网络(GAN)的架构,通过风格化的潜在空间来操控生成过程中的各个特征层。

- 风格表示:StyleGAN的风格表示是通过潜在空间的点控制的,这些点通过映射网络转换成多个层次的风格控制参数。

- 控制粒度:StyleGAN可以精细地控制生成图像的各个方面,从而产生丰富多样的变体。

- 优势:StyleGAN在生成全新的、真实感极强的图像方面表现出色,尤其适用于需要高分辨率和高质量输出的应用。

对比分析

- 风格迁移 vs. 图像生成:CAST专注于风格迁移,即将一个已有图像的风格应用到另一个图像上;而StyleGAN更侧重于从随机潜在空间生成新图像的风格特征。

- 优化方法:CAST通过对比学习来优化风格特征的表示,而StyleGAN通过GAN的对抗性训练来学习生成风格化图像。

- 应用场景:CAST适用于艺术风格迁移和图像编辑,StyleGAN适用于创建新图像、模拟现实世界对象的变体或数据增强。

CAST在风格保真度和内容结构保持方面可能更优,而StyleGAN在创建多样化和高分辨率图像方面表现更佳。