- 1金融数据的pandas模块应用

- 2大数据可视化当当网图书结课代码流程_当当网书籍可视化分析怎么做

- 3Flutter InkWell - Flutter每周一组件_flutter. inkwell使用详解

- 4数学建模熵权法_熵权法计算时要剔除标准差的因素吗

- 5[数据挖掘之scikit-learn] sklean.naive_bayes实例详解_sklearning na茂ve bayes

- 6【MySQL学习】使用正则表达式进行搜索_mysql全文索引使用正则表达式来进行搜索

- 7git实现多人协作开发同一个项目_局域网git多人协同开发

- 8ECharts配合Node.js爬虫实现数据可视化_node.js+echarts

- 9Backend TkAgg is interactive backend. Turning interactive mode on.

- 10Python cvzone 手势识别

昇思MindSpore 25天学习打卡营|day3

赞

踩

数据集 Dataset

数据是深度学习的基础,高质量的数据输入将在整个深度神经网络中起到积极作用。MindSpore提供基于Pipeline的数据引擎,通过数据集(Dataset)和数据变换(Transforms)实现高效的数据预处理。

mindspore.dataset提供了内置的文本、图像、音频等数据集加载接口,并提供了自定义数据集加载接口。此外MindSpore的领域开发库也提供了大量的预加载数据集,可以使用API一键下载使用。

数据集加载

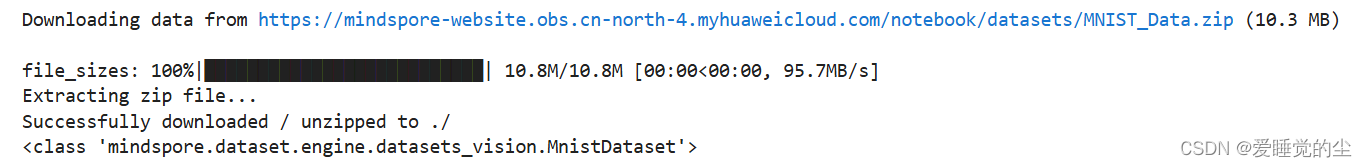

使用Mnist数据集作为样例,介绍使用mindspore.dataset进行加载的方法。

mindspore.dataset提供的接口仅支持解压后的数据文件,因此要使用download库下载数据集并解压,下附加载代码。

- # 从开放数据库下载数据集

- from download import download

-

- url = "https://mindspore-website.obs.cn-north-4.myhuaweicloud.com/" \

- "notebook/datasets/MNIST_Data.zip"

- path = download(url, "./", kind="zip", replace=True)

-

- # 加载文件并打印类型

- train_dataset = MnistDataset("MNIST_Data/train", shuffle=False)

- print(type(train_dataset))

从代码运行结果图可以看出数据的类型是MnistDataset

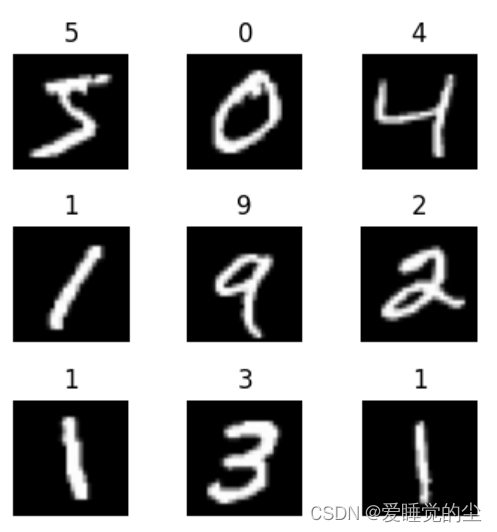

数据集迭代

数据集加载后,一般以迭代方式获取数据,然后送入神经网络中进行训练。我们可以用create_tuple_iterator或create_dict_iterator接口创建数据迭代器,迭代访问数据。

访问的数据类型默认为张量(Tensor);若设置output_numpy=True,访问的数据类型为Numpy。

下面定义一个可视化函数,迭代9张图片进行展示:

- import matplotlib.pyplot as plt

-

- def visualize(dataset):

- figure = plt.figure(figsize=(4, 4))

- cols, rows = 3, 3

-

- plt.subplots_adjust(wspace=0.5, hspace=0.5)

-

- # enumerate函数用于跟踪当前的迭代次数(索引)

- for idx, (image, label) in enumerate(dataset.create_tuple_iterator()):

- figure.add_subplot(rows, cols, idx + 1)

- plt.title(int(label))

- plt.axis("off")

- plt.imshow(image.asnumpy().squeeze(), cmap="gray")

- if idx == cols * rows - 1:

- break

- plt.show()

-

- visualize(train_dataset)

数据集常用操作

Pipeline的设计理念使得数据集的常用操作采用dataset = dataset.operation()的异步执行方式,执行操作返回新的Dataset,此时不执行具体操作,而是在Pipeline中加入节点,最终进行迭代时,并行执行整个Pipeline。

下面分别介绍几种常见的数据集操作。

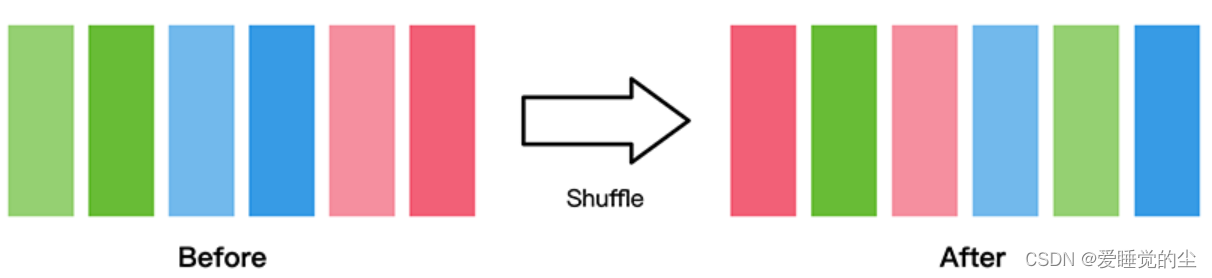

shuffle

数据集随机shuffle可以消除数据排列造成的分布不均问题。

mindspore.dataset提供的数据集在加载时可配置shuffle=True

map

map操作是数据预处理的关键操作,可以针对数据集指定列(column)添加数据变换(Transforms),将数据变换应用于该列数据的每个元素,并返回包含变换后元素的新数据集。

Dataset支持的不同变换类型详见数据变换Transforms。

这里我们对Mnist数据集做数据缩放处理,将图像统一除以255,数据类型由uint8转为了float32。

- image, label = next(train_dataset.create_tuple_iterator())

- print(image.shape, image.dtype)

-

- train_dataset = train_dataset.map(vision.Rescale(1.0 / 255.0, 0), input_columns='image')

-

- image, label = next(train_dataset.create_tuple_iterator())

- print(image.shape, image.dtype)

数据缩放前: (28, 28, 1) UInt8

数据缩放后: (28, 28, 1) Float32

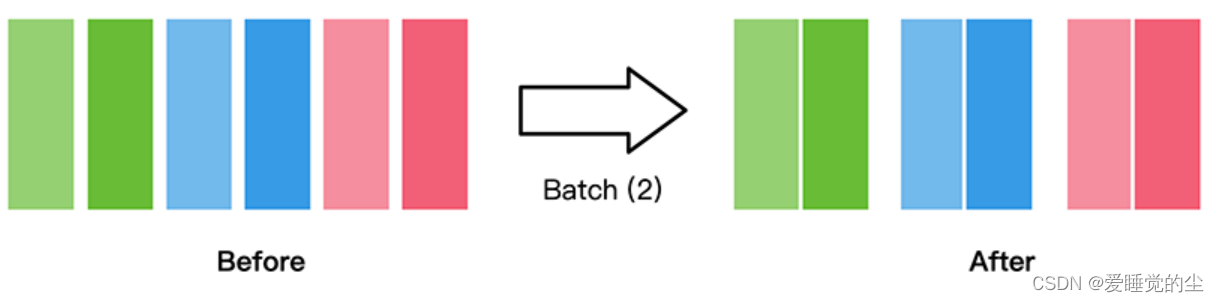

batch

将数据集打包为固定大小的batch是在有限硬件资源下使用梯度下降进行模型优化的折中方法,可以保证梯度下降的随机性和优化计算量。

一般我们会设置一个固定的batch size,将连续的数据分为若干批(batch)。

自定义数据集

mindspore.dataset模块提供了一些常用的公开数据集和标准格式数据集的加载API。

对于MindSpore暂不支持直接加载的数据集,可以构造自定义数据加载类或自定义数据集生成函数的方式来生成数据集,然后通过GeneratorDataset接口实现自定义方式的数据集加载。

GeneratorDataset支持通过可随机访问数据集对象、可迭代数据集对象和生成器(generator)构造自定义数据集,下面分别对其进行介绍。

可随机访问数据集

可随机访问数据集是实现了__getitem__和__len__方法的数据集,表示可以通过索引/键直接访问对应位置的数据样本。

可迭代数据集

可迭代的数据集是实现了__iter__和__next__方法的数据集,表示可以通过迭代的方式逐步获取数据样本。这种类型的数据集特别适用于随机访问成本太高或者不可行的情况。

生成器

生成器也属于可迭代的数据集类型,其直接依赖Python的生成器类型generator返回数据,直至生成器抛出StopIteration异常。

心得

今天学习了数据集的一些常用操作,从加载到预处理,对数据集有了一定程度的了解。数据是深度学习的基础,高质量的数据输入将在整个深度神经网络中起到积极作用。MindSpore通过Dataset(数据集)和Transforms(数据变换)实现高效的数据预处理。通过这次学习,我对于Mindspore的了解更深了,也更有兴趣了。