- 1金融数据的pandas模块应用

- 2大数据可视化当当网图书结课代码流程_当当网书籍可视化分析怎么做

- 3Flutter InkWell - Flutter每周一组件_flutter. inkwell使用详解

- 4数学建模熵权法_熵权法计算时要剔除标准差的因素吗

- 5[数据挖掘之scikit-learn] sklean.naive_bayes实例详解_sklearning na茂ve bayes

- 6【MySQL学习】使用正则表达式进行搜索_mysql全文索引使用正则表达式来进行搜索

- 7git实现多人协作开发同一个项目_局域网git多人协同开发

- 8ECharts配合Node.js爬虫实现数据可视化_node.js+echarts

- 9Backend TkAgg is interactive backend. Turning interactive mode on.

- 10Python cvzone 手势识别

datax的安装以及使用python3的环境_datax python3

赞

踩

一、介绍

datax官网DataX 是阿里云 DataWorks数据集成 的开源版本,在阿里巴巴集团内被广泛使用的离线数据同步工具/平台。DataX 实现了包括 MySQL、Oracle、OceanBase、SqlServer、Postgre、HDFS、Hive、ADS、HBase、TableStore(OTS)、MaxCompute(ODPS)、Hologres、DRDS, databend 等各种异构数据源之间高效的数据同步功能。

Quick Start 下载

Download DataX下载地址

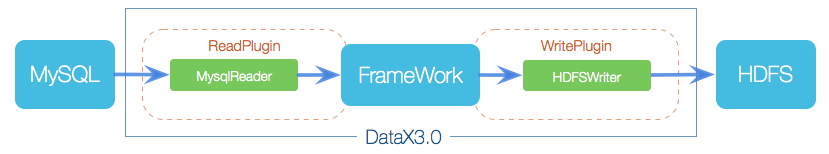

二、DataX3.0框架设计

DataX本身作为离线数据同步框架,采用Framework + plugin架构构建。将数据源读取和写入抽象成为Reader/Writer插件,纳入到整个同步框架中。

- Reader:Reader�为数据采集模块,负责采集数据源的数据,将数据发送给Framework。

- Writer: Writer为数据写入模块,负责不断向Framework取数据,并将数据写入到目的端。

- Framework:Framework用于连接reader和writer,作为两者的数据传输通道,并处理缓冲,流控,并发,数据转换等核心技术问题

三. DataX3.0插件体系

经过几年积累,DataX目前已经有了比较全面的插件体系,主流的RDBMS数据库、NOSQL、大数据计算系统都已经接入。DataX目前支持数据如下:

| 类型 | 数据源 | Reader(读) | Writer(写) | 文档 |

|---|---|---|---|---|

| RDBMS 关系型数据库 | MySQL | √ | √ | 读 、写 |

| Oracle | √ | √ | 读 、写 | |

| OceanBase | √ | √ | 读 、写 | |

| SQLServer | √ | √ | 读 、写 | |

| PostgreSQL | √ | √ | 读 、写 | |

| DRDS | √ | √ | 读 、写 | |

| 达梦 | √ | √ | 读 、写 | |

| 通用RDBMS(支持所有关系型数据库) | √ | √ | 读 、写 | |

| 阿里云数仓数据存储 | ODPS | √ | √ | 读 、写 |

| ADS | √ | 写 | ||

| OSS | √ | √ | 读 、写 | |

| OCS | √ | √ | 读 、写 | |

| NoSQL数据存储 | OTS | √ | √ | 读 、写 |

| Hbase0.94 | √ | √ | 读 、写 | |

| Hbase1.1 | √ | √ | 读 、写 | |

| MongoDB | √ | √ | 读 、写 | |

| Hive | √ | √ | 读 、写 | |

| 无结构化数据存储 | TxtFile | √ | √ | 读 、写 |

| FTP | √ | √ | 读 、写 | |

| HDFS | √ | √ | 读 、写 | |

| Elasticsearch | √ | 写 |

DataX Framework提供了简单的接口与插件交互,提供简单的插件接入机制,只需要任意加上一种插件,就能无缝对接其他数据源。详情请看官网

四、DataX3.0核心架构

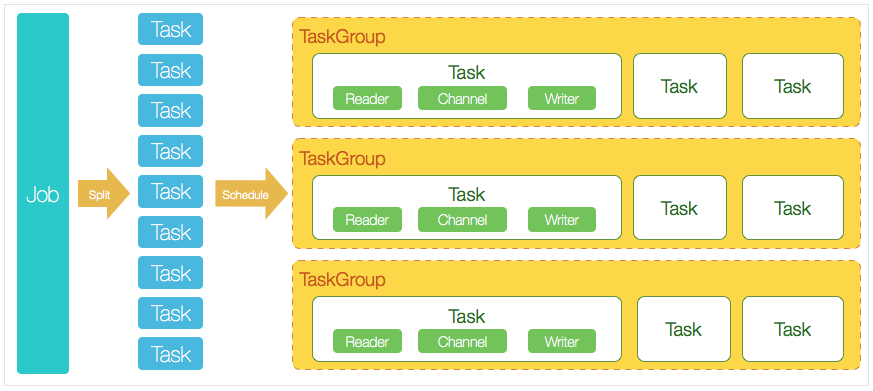

DataX 3.0 开源版本支持单机多线程模式完成同步作业运行,本小节按一个DataX作业生命周期的时序图,从整体架构设计非常简要说明DataX各个模块相互关系。

核心模块介绍:

- DataX完成单个数据同步的作业,我们称之为Job,DataX接受到一个Job之后,将启动一个进程来完成整个作业同步过程。DataX Job模块是单个作业的中枢管理节点,承担了数据清理、子任务切分(将单一作业计算转化为多个子Task)、TaskGroup管理等功能。

- DataXJob启动后,会根据不同的源端切分策略,将Job切分成多个小的Task(子任务),以便于并发执行。Task便是DataX作业的最小单元,每一个Task都会负责一部分数据的同步工作。

- 切分多个Task之后,DataX Job会调用Scheduler模块,根据配置的并发数据量,将拆分成的Task重新组合,组装成TaskGroup(任务组)。每一个TaskGroup负责以一定的并发运行完毕分配好的所有Task,默认单个任务组的并发数量为5。

- 每一个Task都由TaskGroup负责启动,Task启动后,会固定启动Reader—>Channel—>Writer的线程来完成任务同步工作。

- DataX作业运行起来之后, Job监控并等待多个TaskGroup模块任务完成,等待所有TaskGroup任务完成后Job成功退出。否则,异常退出,进程退出值非0

DataX调度流程:

举例来说,用户提交了一个DataX作业,并且配置了20个并发,目的是将一个100张分表的mysql数据同步到odps里面。 DataX的调度决策思路是:

- DataXJob根据分库分表切分成了100个Task。

- 根据20个并发,DataX计算共需要分配4个TaskGroup。

- 4个TaskGroup平分切分好的100个Task,每一个TaskGroup负责以5个并发共计运行25个Task。

五、安装

将软件下载下来通过连接linux工具上传到服务器,datax是开箱即用。上传到服务器解压就可以使用。

1、创建一个存放datax的文件夹

mkdir /export/server/datax

2、将文件夹解压到这个文件中

tar -zxvf datax.tar.gz -C /export/server/datax

3、自检测

python /export/server/datax/bin/datax.py /export/server/datax/job/job.json4、出现一下就表示安装成功

- 2022-11-09 16:04:41.808 [job-0] INFO HookInvoker - No hook invoked, because base dir not exists or is a file: /opt/datax/hook

- 2022-11-09 16:04:41.808 [job-0] INFO JobContainer -

- [total cpu info] =>

- averageCpu | maxDeltaCpu | minDeltaCpu

- -1.00% | -1.00% | -1.00%

-

-

- [total gc info] =>

- NAME | totalGCCount | maxDeltaGCCount | minDeltaGCCount | totalGCTime | maxDeltaGCTime | minDeltaGCTime

- PS MarkSweep | 0 | 0 | 0 | 0.000s | 0.000s | 0.000s

- PS Scavenge | 0 | 0 | 0 | 0.000s | 0.000s | 0.000s

-

- 2022-11-09 16:04:41.809 [job-0] INFO JobContainer - PerfTrace not enable!

- 2022-11-09 16:04:41.809 [job-0] INFO StandAloneJobContainerCommunicator - Total 100000 records, 2600000 bytes | Speed 253.91KB/s, 10000 records/s | Error 0 records, 0 bytes | All Task WaitWriterTime 0.009s | All Task WaitReaderTime 0.044s | Percentage 100.00%

- 2022-11-09 16:04:41.809 [job-0] INFO JobContainer -

- 任务启动时刻 : 2022-11-09 16:04:31

- 任务结束时刻 : 2022-11-09 16:04:41

- 任务总计耗时 : 10s

- 任务平均流量 : 253.91KB/s

- 记录写入速度 : 10000rec/s

- 读出记录总数 : 100000

- 读写失败总数 : 0

六、更改为python3环境

将原来的python2环境改为python3,将以下文件放入到datax的bin目录下

七、运行指令

进入到datax的主目录下

python ./bin/datax.py ./job/你写的json文件