- 1毕设/私活/bigold必备项目,一个挣钱的免费的全开源标准前后端分离后台管理权限系统【springboot+vue+redis+Spring Security】脚手架搭建:若依Ruo框架具体使用教程_基于若依的毕业设计

- 226、RedisCluster的java客户端_redis cluster java客户端

- 32024已经很冷,2024年Android工作或更难找——面试基础技能罗列,android开发视频教学下载地址

- 4基于PyG搭建GCN-LSTM时空犯罪预测_lstm进行犯罪预测

- 5最新开源对话大模型glm-4-9b-chat本地部署使用

- 6命名实体识别(NER)学习笔记

- 7【随笔】Git 高级篇 -- 获取远程分支数据 git fetch(二十七)

- 8毕业设计 - 题目:基于深度学习的中文对话问答机器人_本科毕业设计智能对话系统题目

- 9使用 ZTM 增强极空间 NAS 的远程访问能力_极空间远程访问

- 10python pandas excel文件如何一次性读取全部sheet,并重新一次性写入多个sheet?_pandas excel文件所有表

Pyhton可视化(1) 历年中国大学学术排行榜_historical-ranking-data-visualization-based-on-d3修_python 历年历史排名

赞

踩

11print(‘爬取失败’)

上面需要注意的是,不同年份网页采用的编码不同,返回response.test会乱码,返回response.content则不会。关于编码乱码的问题,以后单独写一篇文章。

2.2.3. 解析表格

用read\_html函数一行代码来抓取表格,然后输出:

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

1tb = pd.read_html(html)[0]

2print(tb)

可以看到,很顺利地表格就被抓取了下来:

但是表格需要进行处理,比如删除掉不需要的评分列,增加年份列等,代码实现如下:

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

1tb = pd.read_html(html)[0]

2# 重命名表格列,不需要的列用数字表示

3tb.columns = [‘world rank’,‘university’, 2,3, ‘score’,5,6,7,8,9,10]

4tb.drop([2,3,5,6,7,8,9,10],axis = 1,inplace = True)

5# 删除后面不需要的评分列

6# rank列100名后是区间,需需唯一化,增加一列index作为排名

7tb[‘index_rank’] = tb.index

8tb[‘index_rank’] = tb[‘index_rank’].astype(int) + 1

9

10# 增加一列年份列

11tb[‘year’] = i

12# read_html没有爬取country,需定义函数单独爬取

13tb[‘country’] = get_country(html)

14return tb

需要注意的是,国家没有被抓取下来,因为国家是用的图片表示的,定位到国家代码位置:

可以看到美国是用英文的USA表示的,那么我们可以单独提取出src属性,然后用正则提取出国家名称就可以了,代码实现如下:

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

1# 提取国家名称

2def get_country(html):

3 soup = BeautifulSoup(html,‘lxml’)

4 countries = soup.select(‘td > a > img’)

5 lst = []

6 for i in countries:

7 src = i[‘src’]

8 pattern = re.compile(‘flag./(.?).png’)

9 country = re.findall(pattern,src)[0]

10 lst.append(country)

11 return lst

然后,我们就可以输出一下结果:

- 1

- 2

- 3

- 4

- 5

1 world rank university score index_rank year country

20 1 哈佛大学 100.0 1 2018 USA

31 2 斯坦福大学 75.6 2 2018 USA

42 3 剑桥大学 71.8 3 2018 UK

53 4 麻省理工学院 69.9 4 2018 USA

64 5 加州大学-伯克利 68.3 5 2018 USA

75 6 普林斯顿大学 61.0 6 2018 USA

86 7 牛津大学 60.0 7 2018 UK

97 8 哥伦比亚大学 58.2 8 2018 USA

108 9 加州理工学院 57.4 9 2018 USA

119 10 芝加哥大学 55.5 10 2018 USA

1210 11 加州大学-洛杉矶 51.2 11 2018 USA

1311 12 康奈尔大学 50.7 12 2018 USA

1412 12 耶鲁大学 50.7 13 2018 USA

1513 14 华盛顿大学-西雅图 50.0 14 2018 USA

1614 15 加州大学-圣地亚哥 47.8 15 2018 USA

1715 16 宾夕法尼亚大学 46.4 16 2018 USA

1816 17 伦敦大学学院 46.1 17 2018 UK

1917 18 约翰霍普金斯大学 45.4 18 2018 USA

2018 19 苏黎世联邦理工学院 43.9 19 2018 Switzerland

2119 20 华盛顿大学-圣路易斯 42.1 20 2018 USA

2220 21 加州大学-旧金山 41.9 21 2018 USA

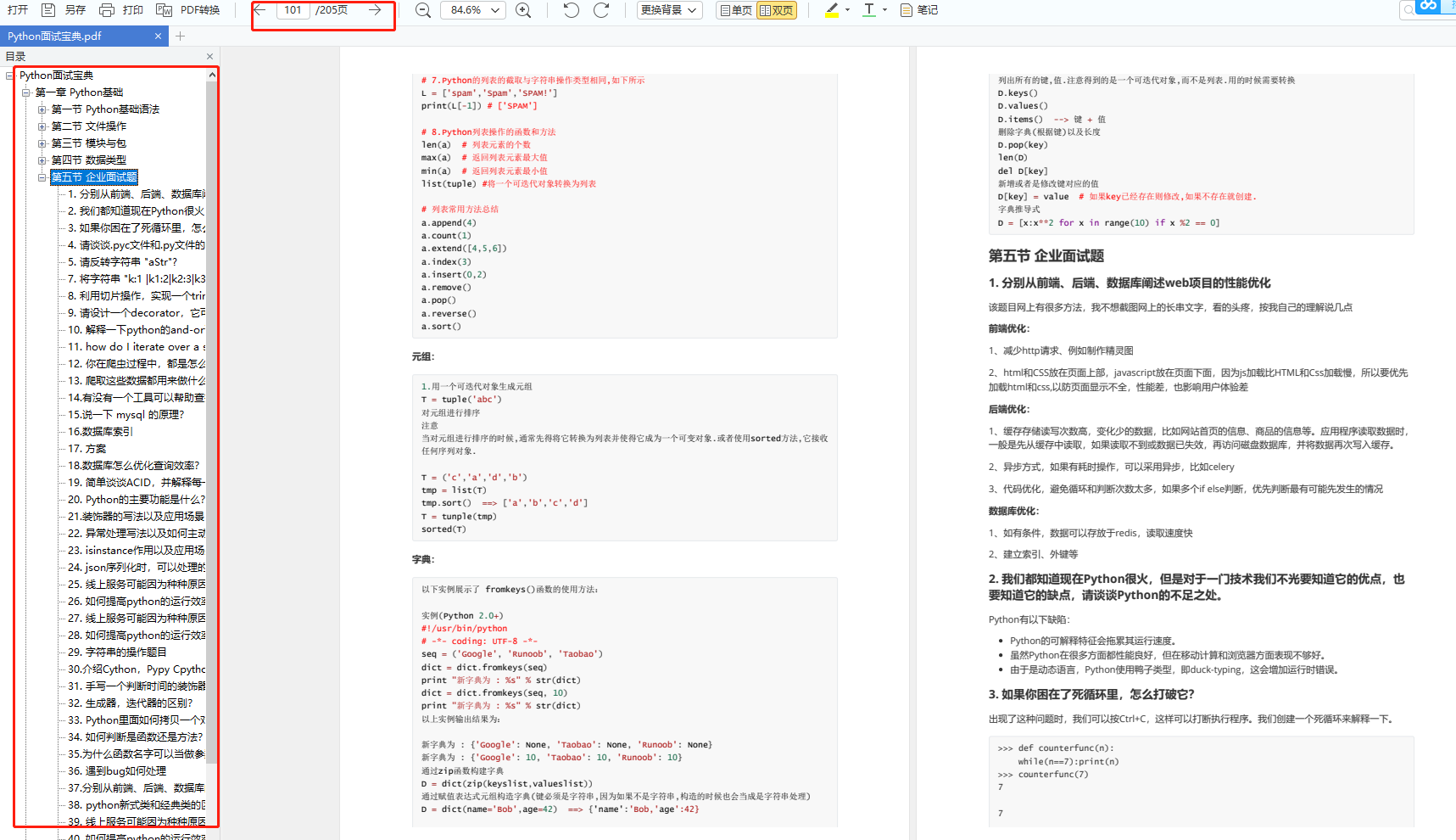

数据很完美,接下来就可以按照D3.js模板中的example.csv文件的格式作进一步的处理了。 #### 2.3. 数据处理 这里先将数据输出为`university.csv`文件,结果见下表:  10年一共5011行×6列数据。接着,读入该表作进一步数据处理,代码如下:

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

1df = pd.read_csv(‘university.csv’)

2# 包含港澳台

3# df = df.query(“(country == ‘China’)|(country == ‘China-hk’)|(country == ‘China-tw’)|(country == ‘China-HongKong’)|(country == ‘China-Taiwan’)|(country == ‘Taiwan,China’)|(country == ‘HongKong,China’)”)[[‘university’,‘year’,‘index_rank’]]

4

5# 只包括内地

6df = df.query(“(country == ‘China’)”)

7df[‘index_rank_score’] = df[‘index_rank’]

8# 将index_rank列转为整形

9df[‘index_rank’] = df[‘index_rank’].astype(int)

10

11# 美国

12# df = df.query(“(country == ‘UnitedStates’)|(country == ‘USA’)”)

13

14#求topn名

15def topn(df):

16 top = df.sort_values([‘year’,‘index_rank’],ascending = True)

17 return top[:20].reset_index()

18df = df.groupby(by =[‘year’]).apply(topn)

19

20# 更改列顺序

21df = df[[‘university’,‘index_rank_score’,‘index_rank’,‘year’]]

22# 重命名列

23df.rename (columns = {‘university’:‘name’,‘index_rank_score’:‘type’,‘index_rank’:‘value’,‘year’:‘date’},inplace = True)

24

25# 输出结果

26df.to_csv(‘university_ranking.csv’,mode =‘w’,encoding=‘utf_8_sig’, header=True, index=False)

27# index可以设置

上面需要注意两点: * 可以提取包含港澳台在内的大中华区所有的大学,也可以只提取内地的大学,还可以提取世界、美国等各种排名。 * 定义了一个求Topn的函数,能够按年份分别求出各年的前20名大学名单。 打开输出的`university_ranking.csv`文件:  结果非常好,可以直接作为D3.js的导入文件了。 2.3.1. 完整代码 将代码再稍微完善一下,完整地代码如下所示:

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

1import pandas as pd

2import csv

3import requests

4from requests.exceptions import RequestException

5from bs4 import BeautifulSoup

6import time

7import re

8

9start_time = time.time() #计算程序运行时间

10# 获取网页内容

11def get_one_page(year):

12 try:

13 headers = {

14 ‘User-Agent’: ‘Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/66.0.3359.181 Safari/537.36’

15 }

16 # 英文版

17 # url = ‘http://www.shanghairanking.com/ARWU%s.html’ % (str(year))

18 # 中文版

19 url = ‘http://www.zuihaodaxue.com/ARWU%s.html’ % (str(year))

20 response = requests.get(url,headers = headers)

21 # 2009-2015用’gbk’,2016-2018用’utf-8’

22 if response.status_code == 200:

23 # return response.text # text会乱码,content没有问题

24 # https://stackoverflow.com/questions/17011357/what-is-the-difference-between-content-and-text

25 return response.content

26 return None

27 except RequestException:

28 print(‘爬取失败’)

29

30# 解析表格

31def parse_one_page(html,i):

32 tb = pd.read_html(html)[0]

33 # 重命名表格列,不需要的列用数字表示

34 tb.columns = [‘world rank’,‘university’, 2,3, ‘score’,5,6,7,8,9,10]

35 tb.drop([2,3,5,6,7,8,9,10],axis = 1,inplace = True)

36 # 删除后面不需要的评分列

37

38 # rank列100名后是区间,需需唯一化,增加一列index作为排名

39 tb[‘index_rank’] = tb.index

40 tb[‘index_rank’] = tb[‘index_rank’].astype(int) + 1

41 # 增加一列年份列

42 tb[‘year’] = i

43 # read_html没有爬取country,需定义函数单独爬取

44 tb[‘country’] = get_country(html)

45 # print(tb) # 测试表格ok

46 return tb

47 # print(tb.info()) # 查看表信息

48 # print(tb.columns.values) # 查看列表名称

49

50# 提取国家名称

51def get_country(html):

52 soup = BeautifulSoup(html,‘lxml’)

53 countries = soup.select(‘td > a > img’)

54 lst = []

55 for i in countries:

56 src = i[‘src’]

57 pattern = re.compile(‘flag./(.?).png’)

58 country = re.findall(pattern,src)[0]

59 lst.append(country)

60 return lst

61 # print(lst) # 测试提取国家是否成功ok

62

63# 保存表格为csv

64def save_csv(tb):

65 tb.to_csv(r’university.csv’, mode=‘a’, encoding=‘utf_8_sig’, header=True, index=0)

66

67 endtime = time.time()-start_time

68 # print(‘程序运行了%.2f秒’ %endtime)

69

70def analysis():

71 df = pd.read_csv(‘university.csv’)

72 # 包含港澳台

73 # df = df.query(“(country == ‘China’)|(country == ‘China-hk’)|(country == ‘China-tw’)|(country == ‘China-HongKong’)|(country == ‘China-Taiwan’)|(country == ‘Taiwan,China’)|(country == ‘HongKong,China’)”)[[‘university’,‘year’,‘index_rank’]]

74 # 只包括内地

75 df = df.query(“(country == ‘China’)”)

76

77 df[‘index_rank_score’] = df[‘index_rank’]

78 # 将index_rank列转为整形

79 df[‘index_rank’] = df[‘index_rank’].astype(int)

80 # 美国

81 # df = df.query(“(country == ‘UnitedStates’)|(country == ‘USA’)”)

82 #求topn名

83 def topn(df):

84 top = df.sort_values([‘year’,‘index_rank’],ascending = True)

85 return top[:20].reset_index()

86 df = df.groupby(by =[‘year’]).apply(topn)

87 # 更改列顺序

88 df = df[[‘university’,‘index_rank_score’,‘index_rank’,‘year’]]

89 # 重命名列

90 df.rename (columns = {‘university’:‘name’,‘index_rank_score’:‘type’,‘index_rank’:‘value’,‘year’:‘date’},inplace = True)

91

92 # 输出结果

93 df.to_csv(‘university_ranking.csv’,mode =‘w’,encoding=‘utf_8_sig’, header=True, index=False)

94 # index可以设置

95

96def main(year):

97 # generate_mysql()

98 for i in range(2009,year): #抓取10年

99 # get_one_page(i)

100 html = get_one_page(i)

101 # parse_one_page(html,i) # 测试表格ok

102 tb = parse_one_page(html,i)

103 save_csv(tb)

104 print(i,‘年排名提取完成完成’)

105 analysis()

106# # 单进程

107if name == ‘main’:

108 main(2019)

109 # 2016-2018采用gb2312编码,2009-2015采用utf-8编码

至此,我们已经有`university_ranking.csv`基础数据,下面就可以进行可视化呈现了。 #### 2.4. 可视化呈现 首先,到作者的github主页: https://github.com/Jannchie/Historical-ranking-data-visualization-based-on-d3.js  2.4.1. 克隆仓库文件 如果你平常使用github或者Git软件的话,那么就找个合适文件存放目录,然后直接在 GitBash里分别输入下面3条命令就搭建好环境了:

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

1# 克隆项目仓库

2git clone https://github.com/Jannchie/Historical-ranking-data-visualization-based-on-d3.js

3# 切换到项目根目录

4cd Historical-ranking-data-visualization-based-on-d3.js

5# 安装依赖

6npm install

学好 Python 不论是就业还是做副业赚钱都不错,但要学会 Python 还是要有一个学习规划。最后大家分享一份全套的 Python 学习资料,给那些想学习 Python 的小伙伴们一点帮助!

一、Python所有方向的学习路线

Python所有方向路线就是把Python常用的技术点做整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

二、学习软件

工欲善其事必先利其器。学习Python常用的开发软件都在这里了,给大家节省了很多时间。

三、全套PDF电子书

书籍的好处就在于权威和体系健全,刚开始学习的时候你可以只看视频或者听某个人讲课,但等你学完之后,你觉得你掌握了,这时候建议还是得去看一下书籍,看权威技术书籍也是每个程序员必经之路。

四、入门学习视频

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了。

五、实战案例

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

六、面试资料

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!