- 1卷积神经网络中的参数学习_卷积核可学习参数

- 2Android8.1设备手工更新WebView_安卓系统webview更新

- 3管理maven项目,隔离开发环境数据库与生产环境数据库_开发环境和生产环境的数据库

- 4MacOS 开发 — NSOpenPanel & NSSavePanel的使用

- 5深入讲解Laravel模板引擎Blade_laravel blade

- 6Flink 配置2:Docker 部署 Flink 集群环境_docker 配置 多环境 flink 集群

- 7 引入创新:H-GCN—为图卷积网络赋能的高效解决方案

- 8Python学习笔记_Windows下Python执行DOS命令_windows如何使用dos执行env环境的python脚本

- 9canal整合rabbitmq_canal1.1.6 + rabbit

- 10谷粒商城 es的检索运用,searchrequest的构建

hadoop(3) 搭建hadoop-HA_hadoop3 ha(2)_hadoop3.2.3 ha搭建

赞

踩

4)重启网卡

node01节点、node01节点、node03节点都需重启网卡

systemctl restart network

- 1

- 2

3.新建用户并添加sudo权限

1)添加用户:useradd 用户名

node01节点、node01节点、node03节点都添加hadoop用户

useradd hadoop

- 1

- 2

2)修改密码:passwd 用户名

node01节点、node01节点、node03节点都修改hadoop密码

passwd hadoop

- 1

- 2

3)修改sudoers文件,给用户sudo权限

node01节点、node01节点、node03节点都在sudoers下添加一行:hadoop ALL=(ALL) ALL

#修改sudoers权限

chmod 777 /etc/sudoers

#修改sudoers文件

vi /etc/sudoers

#在文件/etc/sudoers的root ALL=(ALL) ALL下添加一行

hadoop ALL=(ALL) ALL

#将sudoers文件权限改回来

chmod 440 /etc/sudoers

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

4)修改hosts文件

#编辑/etc/hosts文件

vi /etc/hosts

- 1

- 2

- 3

node01节点、node01节点、node03节点都做以下配置

#在/etc/hosts下添加

192.168.132.101 node01

192.168.132.102 node02

192.168.132.103 node03

- 1

- 2

- 3

- 4

- 5

5)修改hostname文件

#修改/etc/hostname文件

vi /etc/hostname

- 1

- 2

- 3

node01节点配置为node01

node02节点配置为node02

node03节点配置为node03

#将/etc/hostname的文本修改为对应服务器名(master01,node01,node02)

node01

- 1

- 2

- 3

4.时间修改,避免节点心跳时间对不上导致出错

node01节点、node01节点、node03节点都做以下配置

#修改时区 ln -sf /usr/share/zoneinfo/Asia/Shanghai /etc/localtime #修改时间 #查看硬件的时间 hwclock --show #设置硬件时间,正常修改时区就够了,如有需要,可以定一个固定的时间 hwclock --set --date '2024-02-...' #设置系统时间和硬件时间同步 hwclock --hctosys #保存时钟 clock -w

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

5.安装jdk环境

node01节点、node01节点、node03节点都做以下配置

下载地址:https://www.oracle.com/downloads/graalvm-downloads.html

jdk8下载地址:https://www.oracle.com/java/technologies/downloads/#java8

#解压 tar -zxvf jdk-8u401-linux-x64.tar.gz #新建放jdk的文件夹 mkdir -p /usr/java mv jdk1.8.0_401 /usr/java/jdk #编辑/etc/profile文件 vi /etc/profile #添加环境变量 export JAVA\_HOME=/usr/java/jdk export PATH=$JAVA\_HOME/bin:$PATH #刷新环境变量 source /etc/profile #验证 java -version

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

6.安装hadoop

node01节点、node01节点、node03节点都做以下配置

下载地址:https://dlcdn.apache.org/hadoop/common

#解压 tar -zxvf hadoop-3.3.6.tar.gz #移动hadoop到对应的文件夹 mv hadoop-3.3.6 /usr/hadoop #编辑/etc/profile文件 vi /etc/profile #添加环境变量 export HADOOP\_HOME=/usr/hadoop export PATH=$HADOOP\_HOME/bin:$HADOOP\_HOME/sbin:$PATH #刷新环境变量 source /etc/profile #验证 hdfs version

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

7.ssh免密(NameNode需要能ssh免密到其他节点)

1)安装ssh

#安装ssh

yum install ssh

- 1

- 2

- 3

2)生成RSA密钥和公钥

需要先进入对应用户再生成密钥和公钥

node01节点、node01节点、node03节点都进入hadoop用户

su hadoop

- 1

- 2

生成密钥和公钥

#生成RSA密钥和公钥,-t表示type

ssh-keygen -t rsa -P '' -f ~/.ssh/id_rsa

- 1

- 2

- 3

3)在~/.ssh文件夹下新增config,配置需要ssh的服务器信息

#编辑~/.ssh/config

vi ~/.ssh/config

- 1

- 2

- 3

在~/.ssh/config文件下添加ssh的服务器信息

Host node01

HostName 192.168.132.101

User hadoop

IdentitiesOnly yes

Host node02

HostName 192.168.132.102

User hadoop

IdentitiesOnly yes

Host node03

HostName 192.168.132.103

User hadoop

IdentitiesOnly yes

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

修改下config的权限

chmod 600 ~/.ssh/config

- 1

- 2

4)将公钥发送到对应服务器,实现对对应服务器的免密登录

node01和node02有NameNode节点,所以需要能ssh到其他节点

#将公钥发给自己

cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

#在node01上执行,将node01的公钥发给所有node节点,让node01能直接免密登录到其他node节点

ssh-copy-id node02

ssh-copy-id node03

#在node02上执行,将node02的公钥发给所有node节点,让node02能直接免密登录到其他node节点

ssh-copy-id node01

ssh-copy-id node03

#修改下authorized\_keys的权限,否则会无法免密登录

chmod 600 ~/.ssh/authorized_keys

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

6)验证免密登录

node01应能ssh到node02和node03

node02应能ssh到node01和node03

ssh localhost

ssh node01

ssh node02

ssh node03

- 1

- 2

- 3

- 4

- 5

8.安装Zookeeper

node01节点、node01节点、node03节点都做以下配置

下载地址:https://zookeeper.apache.org/releases.html

1)安装zookpper

#解压 tar -zxvf apache-zookeeper-3.8.3-bin.tar.gz #移动zookeeper文件夹 mv apache-zookeeper-3.8.3-bin /usr/zookeeper #编辑/etc/profile文件 vi /etc/profile #添加环境变量 export ZOOKEEPER\_HOME=/usr/zookeeper export PATH=$PATH:$ZOOKEEPER\_HOME/bin #刷新环境变量 source /etc/profile #新建一个存放数据的文件夹 mkdir -p /bigdata/zookeeper

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

2)配置zookpper

复制zoo_sample.cfg为zoo.cfg,默认启动读取zoo.cfg文件

#复制conf/zoo\_sample.cfg

cp /usr/zookeeper/conf/zoo_sample.cfg /usr/zookeeper/conf/zoo.cfg

- 1

- 2

- 3

修改zoo.cfg文件,客户端连接需要配置一个端口,服务需要配置两个端口,一个端口是有主从的使用状态,另一个端口是无主从的选举状态

#编辑zoo.cfg文件

vi /usr/zookeeper/conf/zoo.cfg

#修改以下内容

dataDir=/bigdata/zookeeper

clientPort=2181

#添加以下内容

server.1=node01:2888:3888

server.2=node02:2888:3888

server.3=node03:2888:3888

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

创建myid并添加zoo.cfg配置文件里server后面的权重值

在上面的zoo.cfg配置文件中,node01是server.1,node02是server.2,node03是server.3

因此

在node01节点配置:echo 1 > /bigdata/zookeeper/myid

在node02节点配置:echo 2 > /bigdata/zookeeper/myid

在node03节点配置:echo 3 > /bigdata/zookeeper/myid

echo 1 > /bigdata/zookeeper/myid

- 1

- 2

3)配置权限并启动

修改zookeeper文件权限

node01节点、node01节点、node03节点都执行:chown -R hadoop /usr/zookeeper

chown -R hadoop /usr/zookeeper

chmod -R 770 /usr/zookeeper

- 1

- 2

- 3

修改zookpper数据文件夹权限

node01节点、node01节点、node03节点都执行:chown -R hadoop /bigdata/zookeeper

chown -R hadoop /bigdata/zookeeper

chmod -R 770 /bigdata/zookeeper

- 1

- 2

- 3

启动

需要先切换到对应用户

node01节点、node01节点、node03节点都切换到hadoop用户

su hadoop

- 1

- 2

node01节点、node01节点、node03节点都需要启动后再验证

zkServer.sh start

- 1

- 2

验证

出现Mode: follower或Mode: leader就是启动成功

zkServer.sh status

- 1

- 2

9.hadoop配置hdfs(所有节点可以用同一份配置)

1)修改hadoop-env.sh文件,添加启动的java路径,分布式部署后,每个地方的java路径不一定相同

#编辑hadoop-env.sh文件

vi $HADOOP\_HOME/etc/hadoop/hadoop-env.sh

#取消对应注释并修改为对应java路径

export JAVA\_HOME=/usr/java/jdk

- 1

- 2

- 3

- 4

- 5

2)修改core-site.xml文件,添加启动的namenode节点、zookeeper 节点和对应端口

#编辑core-site.xml文件 vi $HADOOP\_HOME/etc/hadoop/core-site.xml #修改并添加启动的namenode节点、zookeeper 节点和对应端口 <configuration> <property> <!--指定namenode逻辑一对多--> <name>fs.defaultFS</name> <value>hdfs://mycluster</value> </property> <property> <!-- 开启zookeeper --> <name>ha.zookeeper.quorum</name> <value>node01:2181,node02:2181,node03:2181</value> </property> <property> <name>hadoop.tmp.dir</name> <value>/bigdata/hadoop/tmp</value> </property> <property> <name>io.file.buffer.size</name> <value>131702</value> </property> </configuration>

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

3)编辑workers,指定从哪些节点里启动DataNode(2.x版本是编辑slaves)

#编辑workers文件

vi $HADOOP\_HOME/etc/hadoop/workers

#在workers文件里修改并添加DataNode启动节点(把里面默认的localhost去掉)

node02

node03

- 1

- 2

- 3

- 4

- 5

- 6

- 7

4)修改hdfs-site.xml文件,添加副本数量、hdfs的web访问地址、SecondaryNameNode的web访问地址等配置

#编辑hdfs-site.xml文件 vi $HADOOP\_HOME/etc/hadoop/hdfs-site.xml #设置namenode,datanode文件存储地址,web地址等配置 <configuration> <property> <!--指定namenode文件存储地址--> <name>dfs.namenode.name.dir</name> <value>/bigdata/hadoop/hdfs_name</value> </property> <property> <!--指定datanode文件存储地址--> <name>dfs.datanode.data.dir</name> <value>/bigdata/hadoop/hdfs_data</value> </property> <property> <!--指定集群id--> <name>dfs.nameservices</name> <value>mycluster</value> </property> <property> <!--指定namenode逻辑一对多--> <name>dfs.ha.namenodes.mycluster</name> <value>nn1,nn2</value> </property> <property> <!--指定namenode逻辑一对多映射1--> <name>dfs.namenode.rpc-address.mycluster.nn1</name> <value>node01:8081</value> </property> <property> <!--指定namenode逻辑一对多映射2--> <name>dfs.namenode.rpc-address.mycluster.nn2</name> <value>node02:8081</value> </property> <property> <!--指定namenode逻辑一对多映射1的web应用--> <name>dfs.namenode.http-address.mycluster.nn1</name> <value>node01:50070</value> </property> <property> <!--指定namenode逻辑一对多映射2的web应用--> <name>dfs.namenode.http-address.mycluster.nn2</name> <value>node02:50070</value> </property> <property> <!--指定共享edits数据的journal分别在哪些服务器--> <name>dfs.namenode.shared.edits.dir</name> <value>qjournal://node01:8485;node02:8485;node03:8485/mycluster</value> </property> <property> <!--指定共享edits数据的journal存储数据的文件夹--> <name>dfs.journalnode.edits.dir</name> <value>/bigdata/hadoop/ha_hdfs_journal</value> </property> <property> <!--指定代理实现类是什么,在做ha切换的时候,命令发给哪个实现类--> <name>dfs.client.failover.proxy.provider.mycluster</name> <value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value> </property> <property> <!--指定使用什么方式来发送指定代理的信号,sshfence是使用ssh方式--> <name>dfs.ha.fencing.methods</name> <value>sshfence</value> </property> <property> <!--指定ssh方式的免密文件--> <name>dfs.ha.fencing.ssh.private-key-files</name> <value>~/.ssh/id_rsa</value> </property> <property> <!-- 开启namenode同节点的zkfc --> <name>dfs.ha.automatic-failover.enabled</name> <value>true</value> </property> </configuration>

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

- 61

- 62

- 63

- 64

- 65

- 66

- 67

- 68

- 69

- 70

- 71

- 72

- 73

- 74

- 75

- 76

- 77

10.格式化并启动

1)修改hadoop文件权限

node01节点、node01节点、node03节点都执行:chown -R hadoop /usr/hadoop

chown -R hadoop /usr/hadoop

chmod -R 770 /usr/hadoop

- 1

- 2

- 3

2)创建数据存储文件夹

node01节点、node01节点、node03节点都需要创建

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

value>

###### 10.格式化并启动

1)修改hadoop文件权限

node01节点、node01节点、node03节点都执行:chown -R hadoop /usr/hadoop

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

chown -R hadoop /usr/hadoop

chmod -R 770 /usr/hadoop

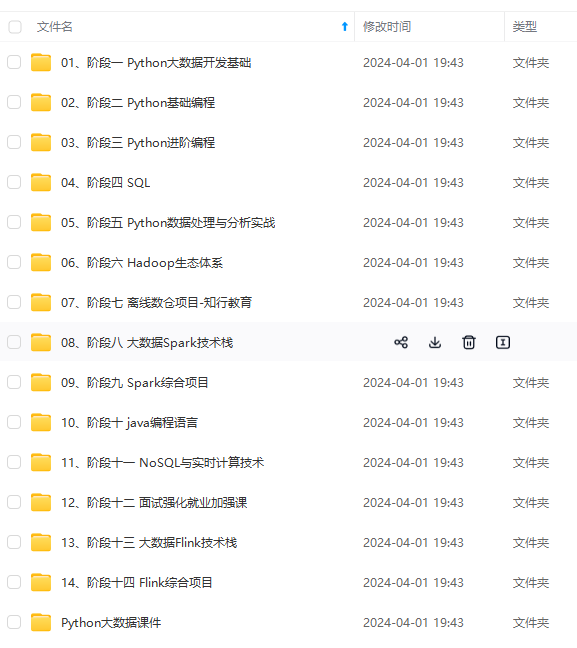

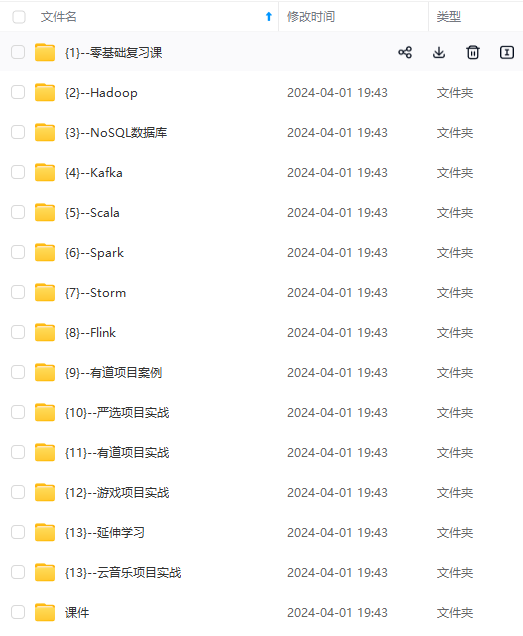

2)创建数据存储文件夹 node01节点、node01节点、node03节点都需要创建 [外链图片转存中...(img-s3jeko71-1714232325752)] [外链图片转存中...(img-LjkaCdfB-1714232325752)] **网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。** **[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/topics/618545628)** **一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17