- 1android log.d 格式化,如何去掉android.Log.d?

- 2./configure: error: SSL modules require the OpenSSL library. You can either do not enable the module

- 3C语言完整版笔记(初阶,进阶,深刨,初阶数据结构)_c语言代码速记

- 401:WebGL简介、示例、应用场景

- 5【漏洞复现】SpringBlade export-user接口存在SQL注入漏洞_springblade漏洞进阶利用

- 6【0基础入门Python Web笔记】四、python 之计算器的进阶之路_python web 计算器代码

- 7人工智能导论/人工智能及其应用 期末练习题_把下列谓词公式化成子句集:( x)( y)(p(x,y)∧q(x,y))

- 8大数据-计算引擎-Spark(三):RDD编程【离线分析;替代MapReduce编程,使用RDD(弹性分布式数据集)编程;处理非结构化数据;RDD操作算子:transformation、Action】_非结构化数据计算引擎有哪些

- 9珠联壁合地设天造|M1 Mac os(Apple Silicon)基于vscode(arm64)配置搭建Java开发环境(集成web框架Springboot)_m1芯片适配的swt

- 10Elasticsearch机器学习初探:智能数据洞察

机器学习——垃圾邮件分类_垃圾邮件分类数据集

赞

踩

目录

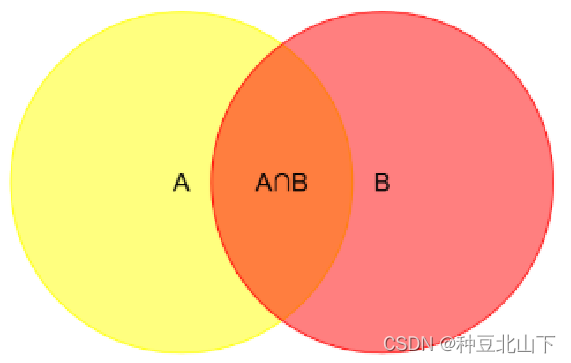

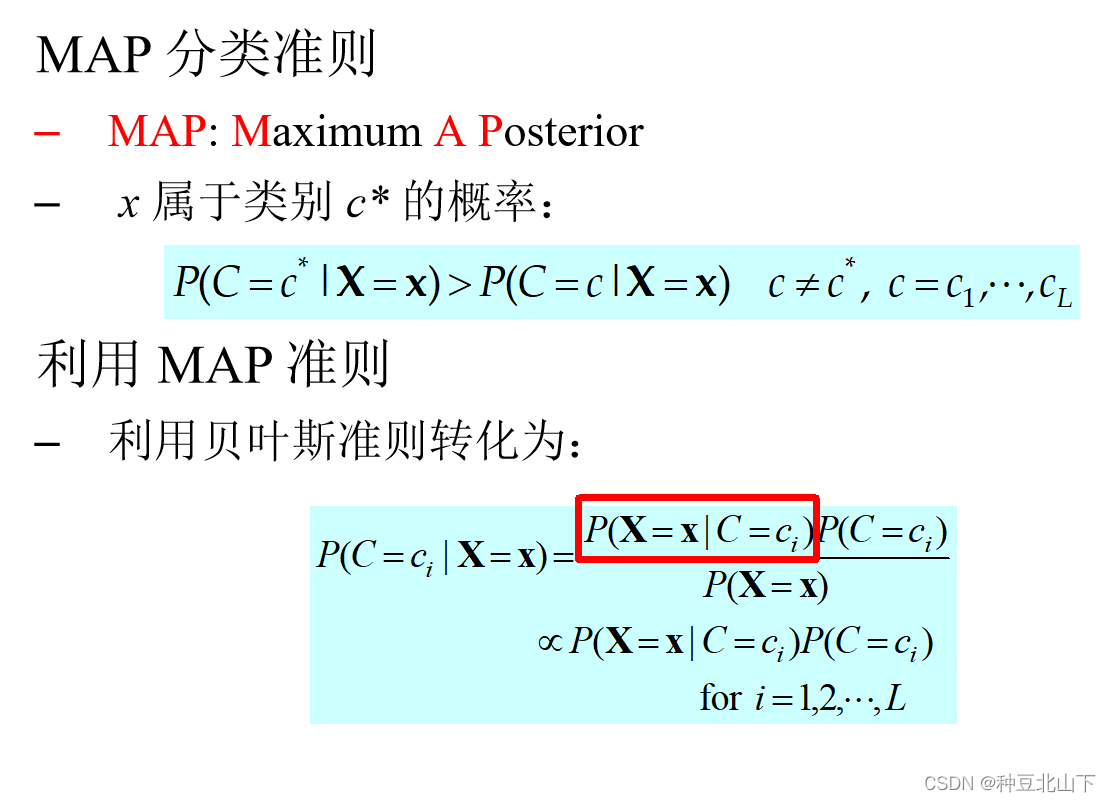

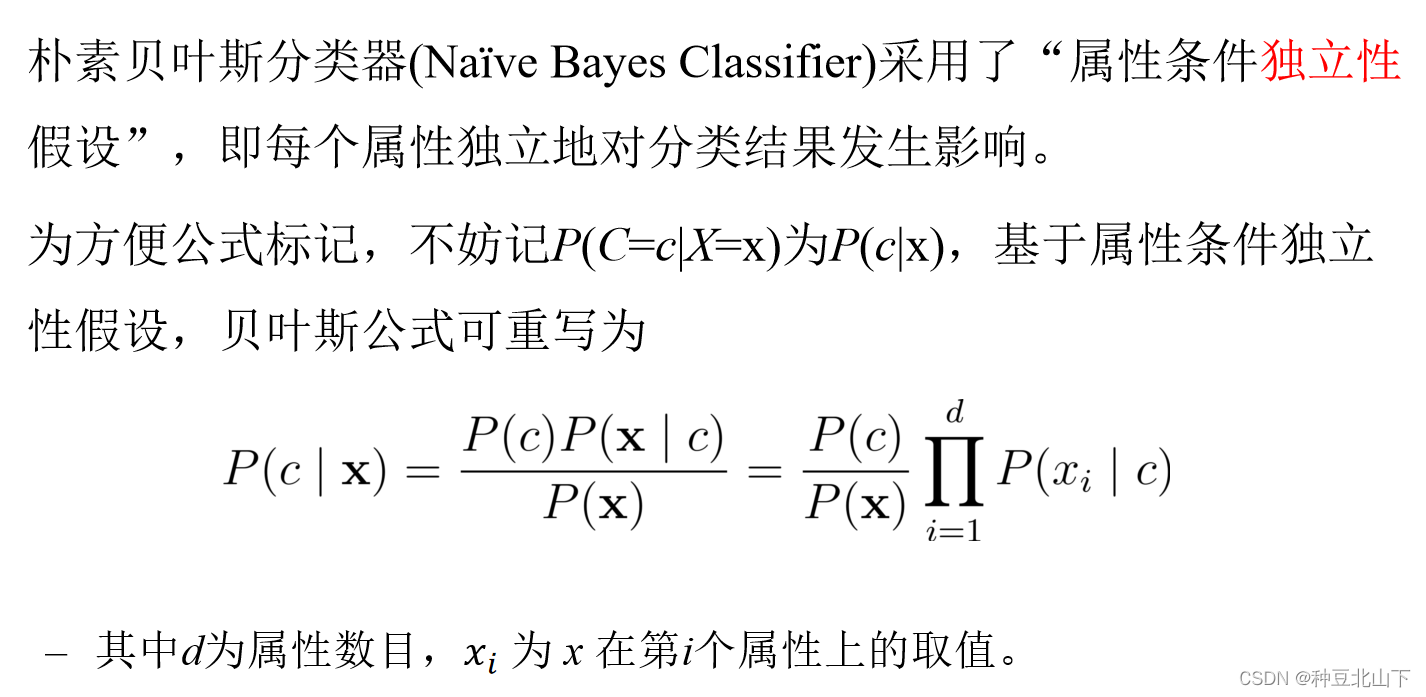

一、贝叶斯公式的介绍

贝叶斯定理 由英国数学家贝叶斯 ( Thomas Bayes 1702-1761 ) 发展,用来描述两个条件 概率 之间的关系

已知两个独立事件A和B,事件B发生的前提下,事件A发生的概率可以表示为P(A|B),即上图中橙色部分占红色部分的比例,即:

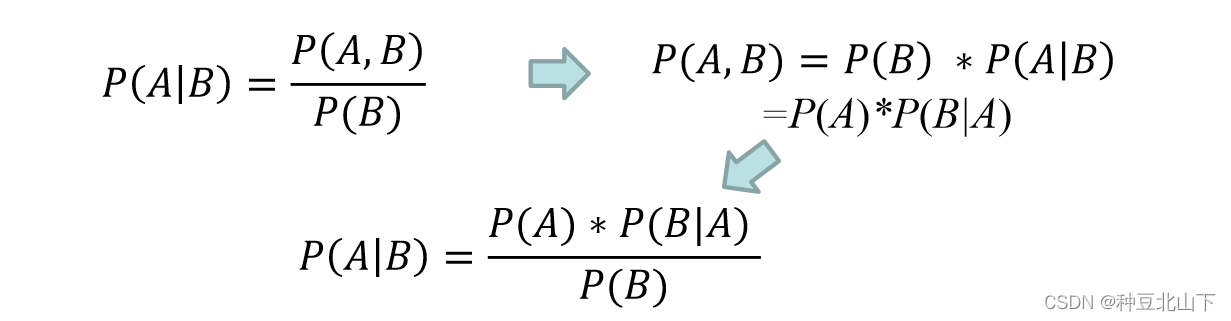

P(A) 称为”先验概率”,即在B事件发生之前,我们对A事件概率的一个判断。如:正常收到一封邮件,该邮件为垃圾邮件的概率就是“先验概率”

P(A|B)称为”后验概率”, 即在B事件发生之后,我们对A事件概率的重新评估。如:邮件中含有“中奖”这个词,该邮件为垃圾邮件的概率就是“后验概率”

P(B|A)/P(B)是可能性函数,这是一个调整因子,使得预估概率更接近真实概率。

条件概率就是:后验概率 = 先验概率 x 调整因子

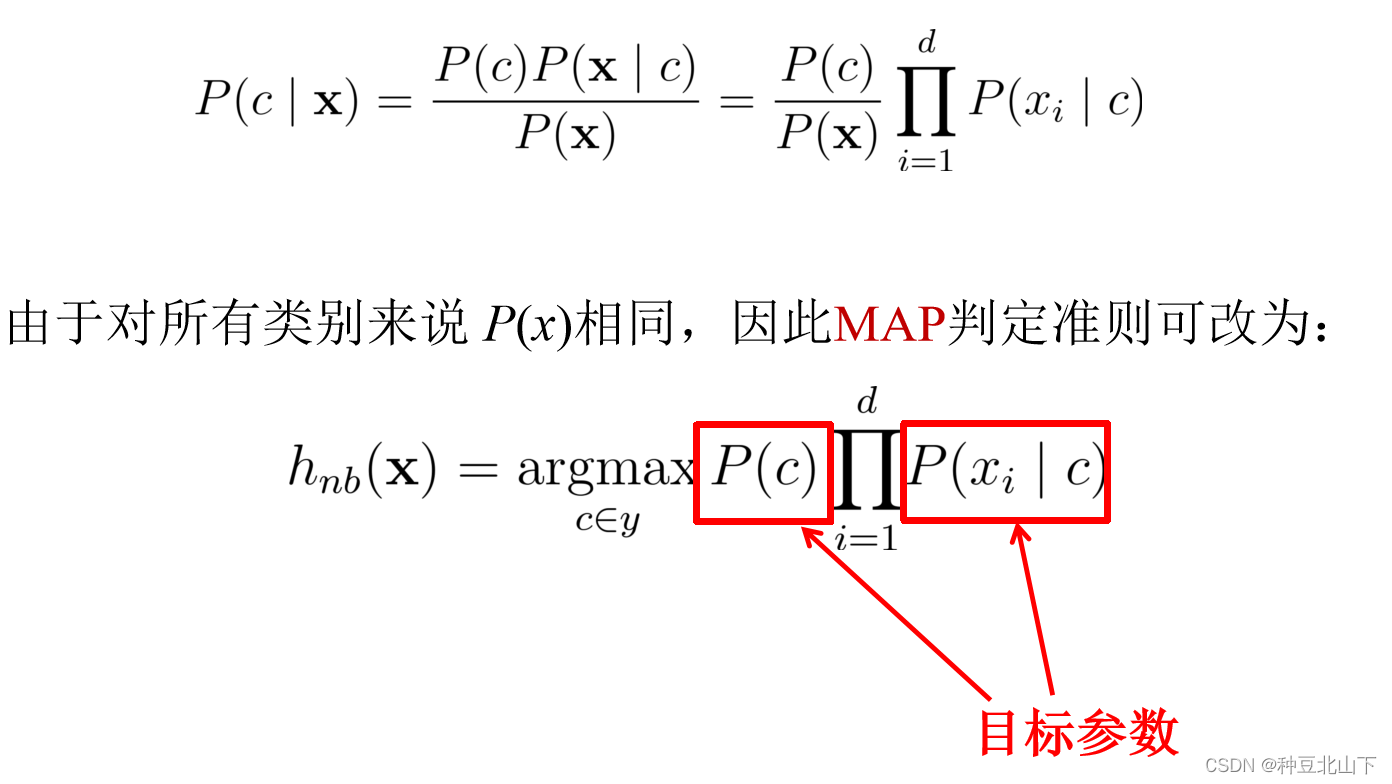

因为要计算两次概率,关于它们的分母,是这个样本的属性在全部样本中的概率。而这两次计算,它们的分母是不变的,所以我们只要计算分子就行。于是有了下面的结论:

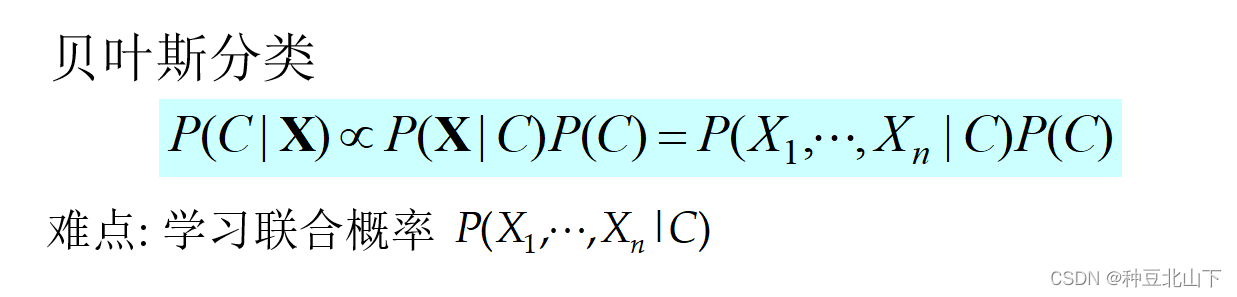

最终我们利用这个公式,在代码中实现概率的计算来对样本进行分类。

二、实验思路

(1)收集数据:提供文本文件。

(2)准备数据:将文本文件解析成词条向量。

(3)分析数据:检查词条确保解析的正确性。

(4)训练算法:计算不同的独立特征的条件概率。

(5)测试算法:计算错误率。

(6)使用算法:构建一个完整的程序对一组文档进行分类。

三、代码实现

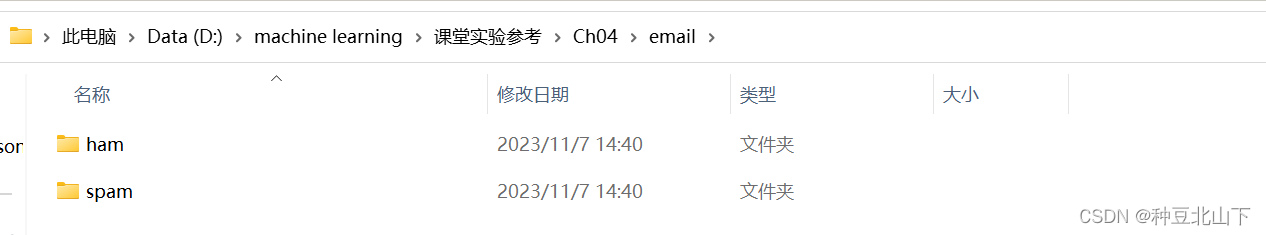

数据集收集:其中ham文件夹下包含25封正常邮件,spam文件夹下包含25封垃圾邮件

加载数据集:

- def createVocabList(dataSet):

- vocabSet = set([]) #create empty set

- for document in dataSet:

- vocabSet = vocabSet | set(document) #union of the two sets

- return list(vocabSet)

对数据进行预处理:

- def setOfWords2Vec(vocabList, inputSet):

- returnVec = [0] * len(vocabList) # 创建一个其中所含元素都为0的向量

- for word in inputSet:

- if word in vocabList: # 如果词条存在于词汇表中,则置1

- returnVec[vocabList.index(word)] = 1

- else:

- print("the word: %s is not in my Vocabulary!" % word)

- return returnVec # 返回文档向量

朴素贝叶斯分类器训练函数:

- def trainNB0(trainMatrix, trainCategory):

- numTrainDocs = len(trainMatrix)

- numWords = len(trainMatrix[0])

- pAbusive = sum(trainCategory) / float(numTrainDocs) # 文档属于垃圾邮件类的概率

- p0Num = np.ones(numWords)

- p1Num = np.ones(numWords) # 词条出现数初始为1,拉普拉斯平滑

- p0Denom = 2.0

- p1Denom = 2.0 # 分母初始为2 ,拉普拉斯平滑

- for i in range(numTrainDocs):

- if trainCategory[i] == 1: # 统计属于侮辱类的条件概率所需的数据

- p1Num += trainMatrix[i]

- p1Denom += sum(trainMatrix[i])

- else: # 统计属于非侮辱类的条件概率所需的数据,即P(w0|0),P(w1|0),P(w2|0)···

- p0Num += trainMatrix[i]

- p0Denom += sum(trainMatrix[i])

- p1Vect = np.log(p1Num / p1Denom)

- p0Vect = np.log(p0Num / p0Denom)

- return p0Vect, p1Vect, pAbusive # 返回属于正常邮件类的条件概率数组,属于侮辱垃圾邮件类的条件概率数组,文档属于垃圾邮件类的概率

朴素贝叶斯分类函数:

-

- def classifyNB(vec2Classify, p0Vec, p1Vec, pClass1):

- p1 = sum(vec2Classify * p1Vec) + np.log(pClass1)

- p0 = sum(vec2Classify * p0Vec) + np.log(1.0 - pClass1)

- if p1 > p0:

- return 1

- else:

- return 0

文档词袋模型:

- def bagOfWords2VecMN(vocabList, inputSet):

- returnVec = [0]*len(vocabList)

- for word in inputSet:

- if word in vocabList:

- returnVec[vocabList.index(word)] += 1

- return returnVec

切分文本:

- def textParse(bigString):

- import re

- listOfTokens = re.split(r'\W*', bigString)

- return [tok.lower() for tok in listOfTokens if len(tok) > 2]

垃圾邮件分类测试函数:

- def spamTest():

- docList = []

- classList = []

- fullText = []

- for i in range(1, 26):

- wordList = textParse(open('D:/machine learning/课堂实验参考/Ch04\email/spam/%d.txt' % i,encoding='ISO-8859-15').read())

- docList.append(wordList)

- fullText.extend(wordList)

- classList.append(1) # 将垃圾邮件标记为1

- wordList = textParse(open('D:/machine learning/课堂实验参考/Ch04/email/ham/%d.txt' % i,encoding='ISO-8859-15').read())

- docList.append(wordList)

- fullText.extend(wordList)

- classList.append(0) # 将正常邮件标记为0

- vocabList = createVocabList(docList)

- trainingSet = list(range(50))

- testSet = []

- for i in range(10):

- randIndex = int(random.uniform(0, len(trainingSet)))

- testSet.append(trainingSet[randIndex])

- del (trainingSet[randIndex])

- trainMat = []

- trainClasses = []

- for docIndex in trainingSet: # 遍历训练集

- trainMat.append(bagOfWords2VecMN(vocabList, docList[docIndex]))

- trainClasses.append(classList[docIndex])

- p0V, p1V, pSpam = trainNB0(array(trainMat), array(trainClasses))

-

-

-

- errorCount = 0

- for docIndex in testSet: # 遍历测试集

- wordVector = bagOfWords2VecMN(vocabList, docList[docIndex])

- if classifyNB(array(wordVector), p0V, p1V, pSpam) != classList[docIndex]:

- errorCount += 1

- print('error classlist:', docList[docIndex])

- print('erro rate:', float(errorCount) / len(testSet)) # 计算错误率

- return float(errorCount) / len(testSet)

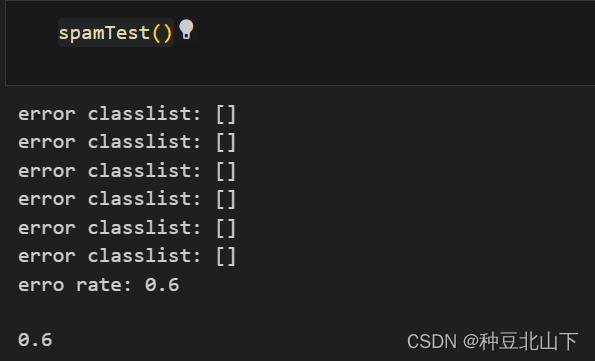

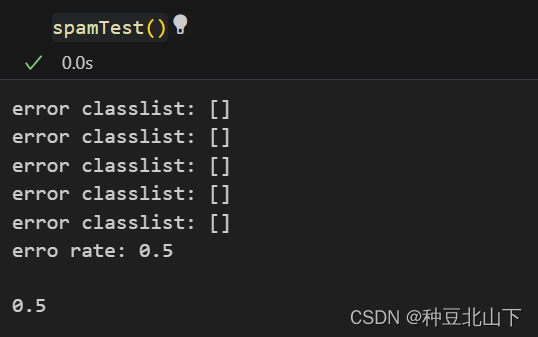

测试结果:

从十个测试结果中一次有五个预测错误,一次有六个预测错误,其中出现的错误都是将垃圾邮件误判为正常邮件,相比之下,将垃圾邮件误判为正常邮件要比将正常邮件归到垃圾邮件好。

四、实验总结

朴素贝叶斯算法的优缺点:

(1)优点:

有稳定的分类效率

对小规模的数据表现很好,能个处理多分类任务,适合增量式训练

对缺失数据不太敏感,算法也比较简单,常用于文本分类

(2)缺点:

理论上,朴素贝叶斯模型与其他分类方法相比具有最小的误差率。但是实际上并非总是如此,这是因为朴素贝叶斯模型给定输出类别的情况下,假设属性之间相互独立,这个假设在实际应用中往往是不成立的,在属性个数比较多或者属性之间相关性较大时,分类效果不好。而在属性相关性较小时,朴素贝叶斯性能最为良好

需要知道先验概率,且先验概率很多时候取决于假设,假设的模型可以有很多种,因此在某些时候会由于假设的先验模型的原因导致预测效果不佳

由于我们是通过先验和数据来决定后验的概率从而决定分类,所以分类决策存在一定的错误率