- 1数据库--链表(基本操作,尾部插入,定点插入,删除指定,释放全部)_链表与数据库结合

- 2毕业设计 - 基于 STM32 的电子计步器的设计与实现_stm32电子计步器

- 3python实现K均值聚类_k均值聚类 python

- 4全能AI客户端:ChatGPT Web Midjourney Proxy,AI绘画+GPT4o对话

- 5过拟合与欠拟合:为机器学习模型选择数据

- 6C++ 数据结构算法 学习笔记(3)-链表_链表c++

- 7C++面试题精选-2024/06/26

- 8【51单片机篇】项目:智能小车_寻迹小车项目概述

- 9作业帮口算批改怎么开 作业帮口算批改如何用

- 10Docker快速入门:安装及配置镜像仓库_配置docker镜像仓库

Flink 的时间属性及原理解析(1)_1. flink时间机制

赞

踩

还有兄弟不知道网络安全面试可以提前刷题吗?费时一周整理的160+网络安全面试题,金九银十,做网络安全面试里的显眼包!

王岚嵚工程师面试题(附答案),只能帮兄弟们到这儿了!如果你能答对70%,找一个安全工作,问题不大。

对于有1-3年工作经验,想要跳槽的朋友来说,也是很好的温习资料!

【完整版领取方式在文末!!】

93道网络安全面试题

需要体系化学习资料的朋友,可以加我V获取:vip204888 (备注网络安全)

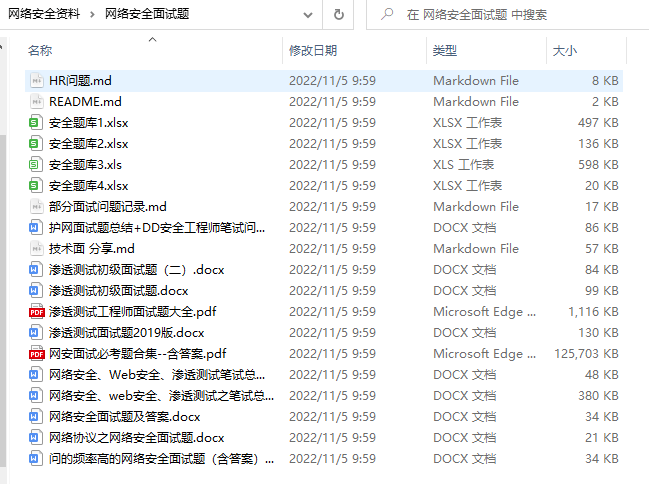

内容实在太多,不一一截图了

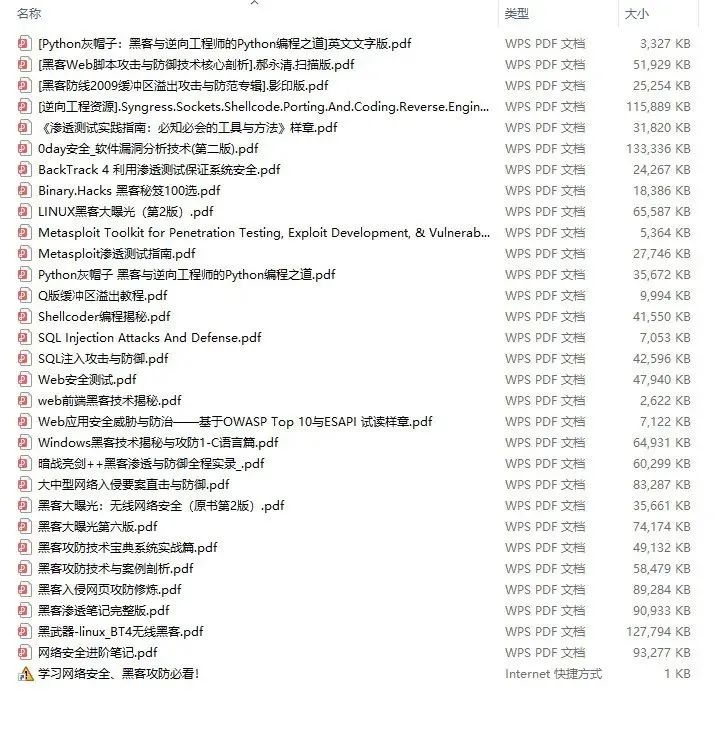

黑客学习资源推荐

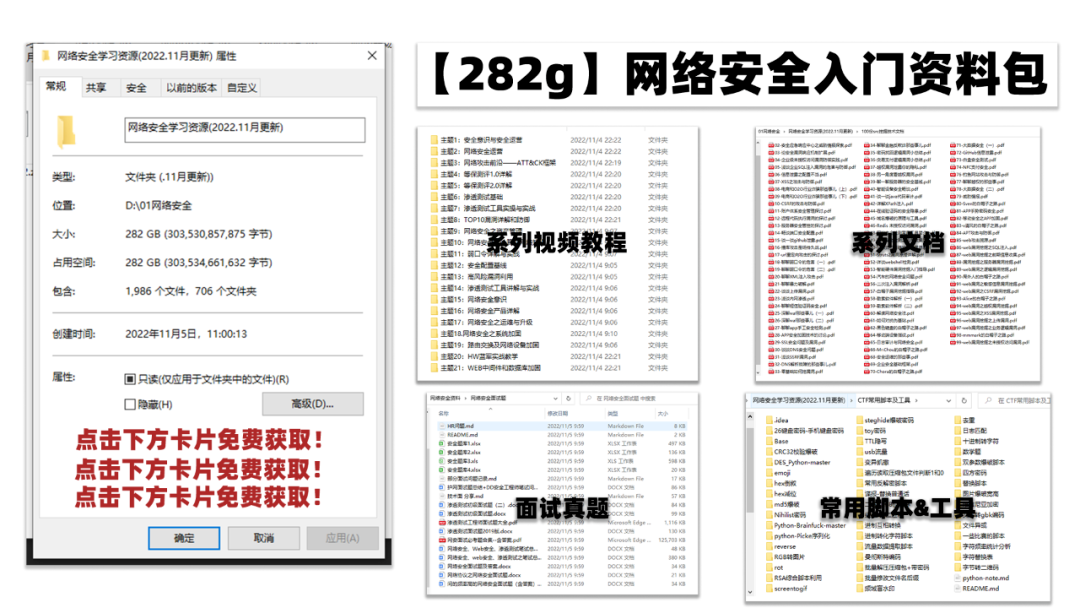

最后给大家分享一份全套的网络安全学习资料,给那些想学习 网络安全的小伙伴们一点帮助!

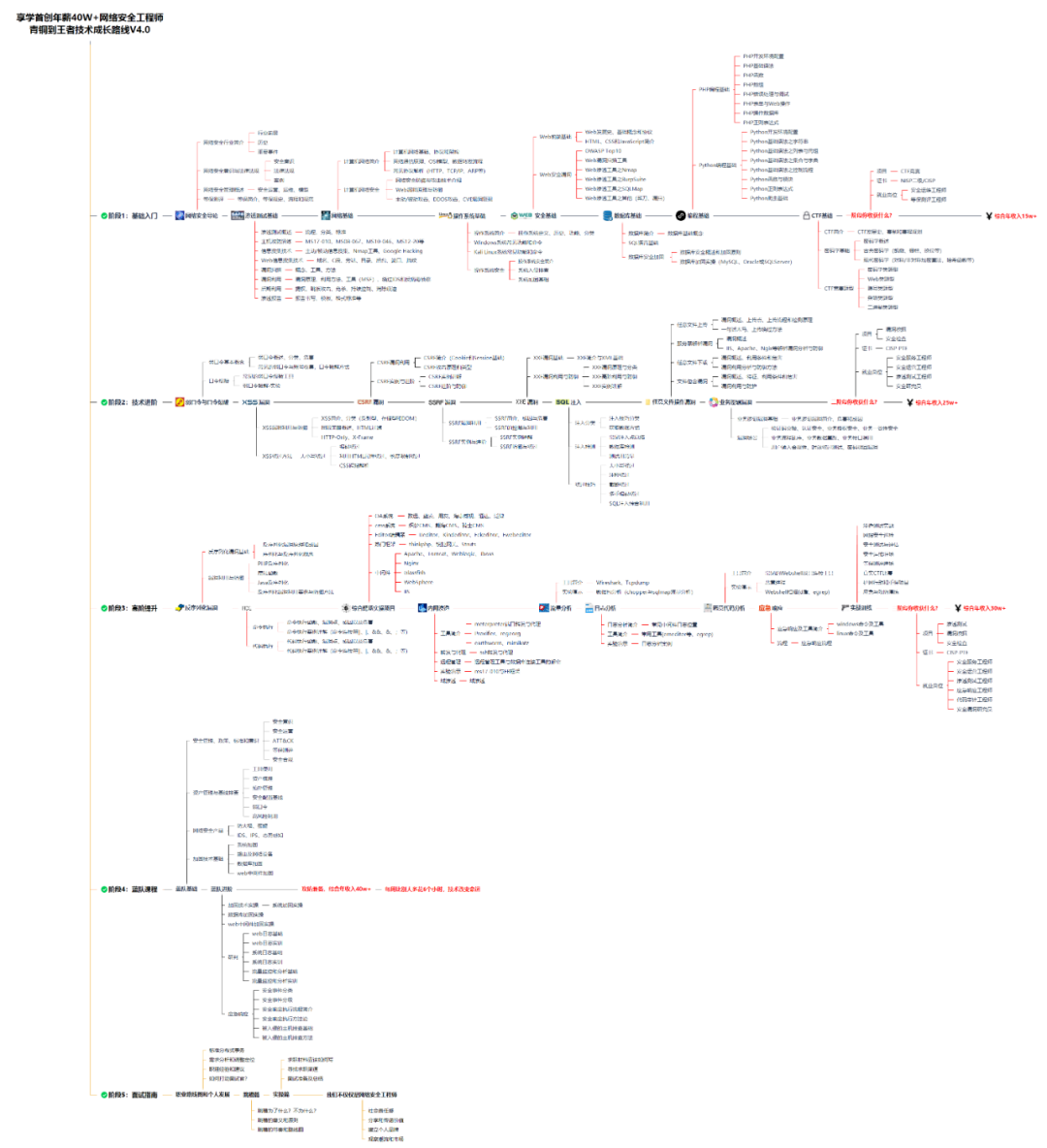

对于从来没有接触过网络安全的同学,我们帮你准备了详细的学习成长路线图。可以说是最科学最系统的学习路线,大家跟着这个大的方向学习准没问题。

1️⃣零基础入门

① 学习路线

对于从来没有接触过网络安全的同学,我们帮你准备了详细的学习成长路线图。可以说是最科学最系统的学习路线,大家跟着这个大的方向学习准没问题。

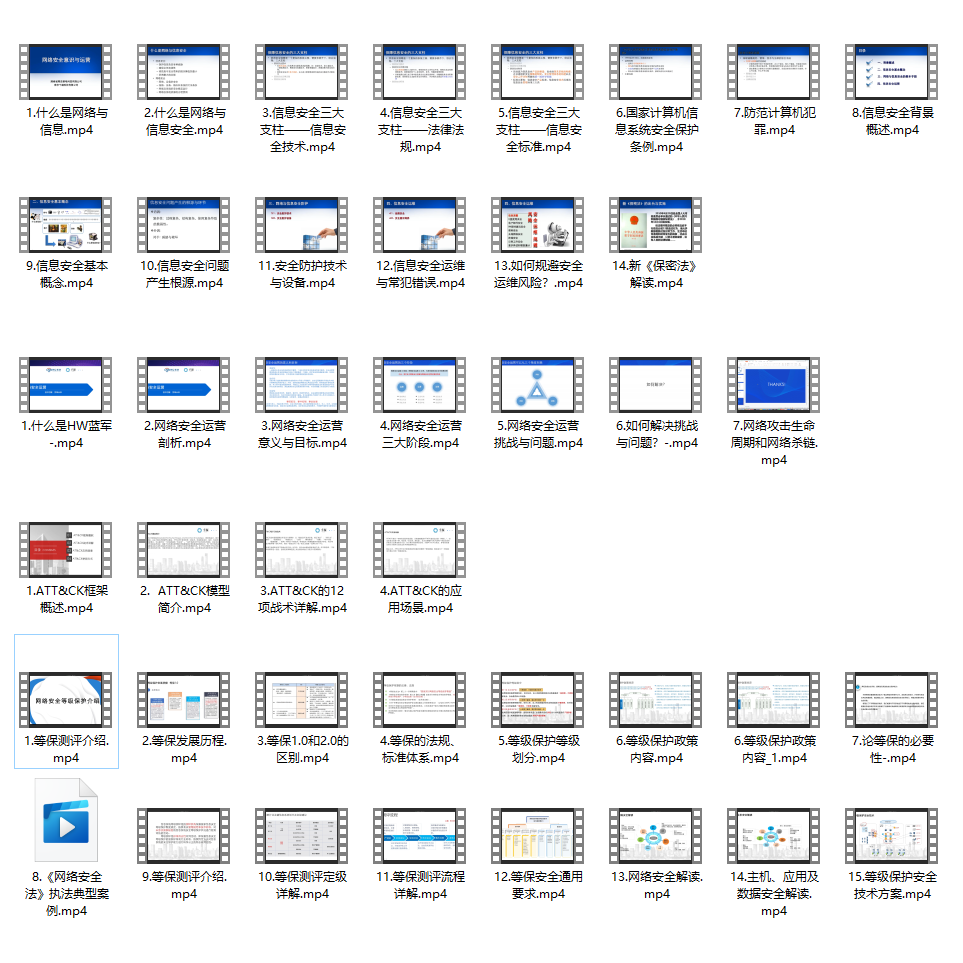

② 路线对应学习视频

同时每个成长路线对应的板块都有配套的视频提供:

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

这个时候我们在整个时间序列里插入一些类似于标志位的特殊的处理数据,这些特殊的处理数据叫做watermark。一个watermark本质上就是一个timestamp数值,表示后到来的数据再也没有小于或等于这个时间watermark的了。

Timestamp 和 Watermark 行为概览

![[点击并拖拽以移动] ](https://img-blog.csdnimg.cn/direct/5c7dfef5e9ac4f4082010a3abe4e10f6.png)

接下来我们重点看一下Event Time里的Record Timestamp(简写成timestamp)和watermark的一些基本信息。绝大多数的分布式流计算引擎对于数据都是进行了 DAG 图的抽象,它有自己的数据源,有处理算子,还有一些数据汇。数据在不同的逻辑算子之间进行流动。watermark和timestamp有自己的生命周期,主要分为watermark和timestamp的产生、他们在不同的节点之间的传播、以及在每一个节点上的处理。

Timestamp分配和Watermark生成: Flink支持两种watermark生成方式。第一种是在SourceFunction中产生,相当于把整个的timestamp分配和watermark生成的逻辑放在流处理应用的源头。我们可以在SourceFunction里面通过这两个方法产生watermark:

【1】通过collectWithTimestamp方法发送一条数据,其中第一个参数就是我们要发送的数据,第二个参数就是这个数据所对应的时间戳;也可以调用emitWatermark去产生一条watermark,表示接下来不会再有时间戳小于等于这个数值记录。

【2】另外,有时候我们不想在SourceFunction里生成timestamp或者watermark,或者说使用的SourceFunction本身不支持,我们还可以在使用DataStreamAPI的时候指定,调用的DataStream.assignTimestampsAndWatermarks这个方法,能够接收不同的timestamp和watermark的生成器。

总体上而言生成器可以分为两类: 第一类是定期生成器;第二类是根据一些在流处理数据流中遇到的一些特殊记录生成的。

| 定期生成 | 根据特殊记录生成 |

|---|---|

| 现实时间驱动 | 数据驱动 |

| 没个一段时间调用生成方法 | 分一次分配Timestamp都会调用生成的方法 |

实现AssignerWithPeriodicWatermarks | 实现 AssignerWithPunctuatedWatermarks |

两者的区别主要有三个方面,首先定期生成是现实时间驱动的,这里的定期生成主要是指watermark(因为timestamp是每一条数据都需要有的),即定期会调用生成逻辑去产生一个watermark。而根据特殊记录生成是数据驱动的,即是否生成watermark不是由现实时间来决定,而是当看到一些特殊的记录就表示接下来可能不会有符合条件的数据再发过来了,这个时候相当于每一次分配Timestamp之后都会调用用户实现的watermark生成方法,用户需要在生成方法中去实现watermark的生成逻辑。

在分配timestamp和生成watermark的过程中,虽然在SourceFunction和DataStream中都可以指定,但是还是建议生成的工作越靠近 DataSource越好。这样会方便让程序逻辑里面更多的 operator 去判断某些数据是否乱序。Flink 内部提供了很好的机制去保证这些timestamp和watermark被正确地传递到下游的节点。

Watermark 传播

具体的传播策略基本上遵循这三点:

【1】watermark会以广播的形式在算子之间进行传播。比如说上游的算子连接了三个下游的任务,它会把自己当前的收到的watermark以广播的形式传到下游。

广播特点: 主机之间“一对所有”的通讯模式,网络对其中每一台主机发出的信号都进行无条件复制并转发,所有主机都可以接收到所有信息(不管你是否需要)

【2】如果在程序里面收到了一个Long.MAX_VALUE这个数值的watermark,就表示对应的那一条流的一个部分不会再有数据发过来了,它相当于就是一个终止的标志。

【3】对于单流而言,这个策略比较好理解,而对于有多个输入的算子,watermark的计算就有讲究了,一个原则是:单输入取其大,多输入取小。

![[点击并拖拽以移动] ](https://img-blog.csdnimg.cn/direct/7962807599b54bb2bce143bfa6dc474e.png)

举个例子,上图蓝色代表一个算子的一个任务,然后它有三个输入,分别是W1、W2、W3,这三个输入可以理解成任何输入,这三个输入可能是属于同一个流,也可能是属于不同的流。然后在计算watermark的时候,对于单个输入而言是取他们的最大值,因为我们都知道 watermark应该遵循一个单调递增的一个原则。对于多输入,它要统计整个算子任务的watermark时,就会取这三个计算出来的watermark的最小值。即一个多个输入的任务,它的watermark受制于最慢的那条输入流。这一点类似于木桶效应,整个木桶中装的水会受制于最矮的那块板。

watermark在传播的时候有一个特点是,它的传播是幂等的。多次收到相同的watermark,甚至收到之前的watermark都不会对最后的数值产生影响,因为对于单个输入永远是取最大的,而对于整个任务永远是取一个最小的。同时我们可以注意到这种设计其实有一个局限,具体体现在它没有区分你这个输入是一条流多个partition还是来自于不同的逻辑上的流的JOIN。对于同一个流的不同partition,我们对他做这种强制的时钟同步是没有问题的,因为一开始就把一条流拆散成不同的部分,但每一个部分之间共享相同的时钟。但是如果算子的任务是在做类似于JOIN操作,那么要求两个输入的时钟强制同步其实没有什么道理的,因为完全有可能是把一条离现在时间很近的数据流和一个离当前时间很远的数据流进行JOIN,这个时候对于快的那条流,因为它要等慢的那条流,所以说它可能就要在状态中去缓存非常多的数据,这对于整个集群来说是一个很大的性能开销。

ProcessFunction

在了解watermark的处理之前,先简单了解ProcessFunction,因为watermark在任务里的处理逻辑分为内部逻辑和外部逻辑。外部逻辑其实就是通过ProcessFunction来体现的,需要使用 Flink提供的时间相关的API的话就只能写在ProcessFunction里。

ProcessFunction和时间相关的功能主要有三点:

【1】根据你当前系统使用的时间语义不同,你可以去获取当前你正在处理这条记录的Record Timestamp,或者当前的Processing Time。

【2】它可以获取当前算子的时间,可以把它理解成当前的watermark。

【3】为了在 ProcessFunction 中去实现一些相对复杂的功能,允许注册一些timer(定时器)。比如说在watermark达到某一个时间点的时候就触发定时器,所有的这些回调逻辑也都是由用户来提供,涉及到如下三个方法,registerEventTimeTimer、registerProcessingTimeTimer和onTimer。在onTimer方法中就需要去实现自己的回调逻辑,当条件满足时回调逻辑就会被触发。

一个简单的应用是,我们在做一些时间相关的处理的时候,可能需要缓存一部分数据,但这些数据不能一直去缓存下去,所以需要有一些过期的机制,我们可以通过timer去设定这么一个时间,指定某一些数据可能在将来的某一个时间点过期,从而把它从状态里删除掉。所有的这些和时间相关的逻辑在Flink内部都是由自己的Time Service(时间服务)完成的。

Watermark 处理

一个算子的实例在收到watermark的时候,首先要更新当前的算子时间,这样的话在ProcessFunction里方法查询这个算子时间的时候,就能获取到最新的时间。第二步它会遍历计时器队列,这个计时器队列就是我们刚刚说到的timer,你可以同时注册很多timer,Flink会把这些Timer按照触发时间放到一个优先队列中。第三步Flink得到一个时间之后就会遍历计时器的队列,然后逐一触发用户的回调逻辑。通过这种方式,Flink的某一个任务就会将当前的watermark发送到下游的其他任务实例上,从而完成整个watermark的传播,从而形成一个闭环。

![[点击并拖拽以移动] ](https://img-blog.csdnimg.cn/direct/1185c9baa6c14824b2e0d304d21b3938.png)

Table API 中的时间

下面看一看Table/SQL API中的时间。为了让时间参与到Table/SQL这一层的运算中,我们需提前把时间属性放到表的schema中,这样的话我们才能够在SQL语句或者Table的逻辑表达式里面使用时间去完成需求。

Table中指定时间列: 其实之前社区就怎么在Table/SQL中去使用时间这个问题做过一定的讨论,是把获取当前Processing Time的方法是作为一个特殊的UDF,还是把这一个列物化到整个的schema里面,最终采用了后者。我们这里就分开来讲一讲Processing Time和Event Time在使用的时候怎么在Table中指定。

| 从DataStream转化 | 通过TableSource 转化 | |

|---|---|---|

| Processing Time | tEnv.fromDataStream(stream,“f1,f2,f3.proctime”) | TableSource实现DefinedProctimeAttributes接口 |

| Event Time | 原始 DataStream 必须有 timestamp 及 watermark | 数据中存在类型为 long或 timestamp的时间字段 |

| Event Time | tEnv.fromDataStream(stream,“f1,f2,f3.rowtime”) tEnv.fromDataStream(stream,“f1.rowtime,f2,f3”) | TableSource实现DefinedProctimeAttributes接口 |

对于Processing Time,我们知道要得到一个Table对象(或者注册一个Table)有两种手段:

● 可以从一个DataStream转化成一个Table;

● 直接通过TableSource去生成这么一个Table;

对于第一种方法而言,我们只需要在你已有的这些列中(例子中f1和f2就是两个已有的列),在最后用“列名.proctime”这种写法就可以把最后的这一列注册为一个Processing Time,以后在写查询的时候就可以去直接使用这一列。如果Table是通过TableSource生成的,就可以通过实现这一个DefinedRowtimeAttributes接口,然后就会自动根据你提供的逻辑去生成对应的Processing Time。

相对而言,在使用EventTime时则有一个限制,因为EventTime不像Processing Time那样是随拿随用。如果要从DataStream去转化得到一个Table,必须要提前保证原始的DataStream里面已经存在了RecordTimestamp和watermark。如果想通过TableSource生成的,也一定要保证要接入的数据里面存在一个类型为long或者timestamp的时间字段。具体来说,如果要从DataStream去注册一个表,和proctime类似,只需要加上“列名.rowtime”就可以。需要注意,如果要用Processing Time,必须保证要新加的字段是整个schema中的最后一个字段,而Event Time的时候其实可以去替换某一个已有的列,然后Flink会自动的把这一列转化成需要的rowtime这个类型。

如果是通过TableSource生成的,只需要实现DefinedRowtimeAttributes接口就可以了。需要说明的一点是,在DataStream API这一侧其实不支持同时存在多个Event Time(rowtime),但是在Table这一层理论上可以同时存在多个rowtime。因为DefinedRowtimeAttributes接口的返回值是一个对于rowtime描述的List,即其实可以同时存在多个rowtime列,在将来可能会进行一些其他的改进,或者基于去做一些相应的优化。

时间列和 Table 操作

指定完了时间列之后,当我们要真正去查询时就会涉及到一些具体的操作。这里我列举的这些操作都是和时间列紧密相关,或者说必须在这个时间列上才能进行的。比如说 Over窗口聚合 和 Group by窗口聚合 这两种窗口聚合,在写SQL提供参数的时候只能允许你在这个时间列上进行这种聚合。第三个就是时间窗口聚合,你在写条件的时候只支持对应的时间列。最后就是排序,我们知道在一个无尽的数据流上对数据做排序几乎是不可能的事情,但因为这个数据本身到来的顺序已经是按照时间属性来进行排序,所以说如果要对一个 DataStream转化成Table进行排序的话,只能是按照时间列进行排序,当然同时也可以指定一些其他的列,但是时间列这个是必须的,并且必须放在第一位。

![[点击并拖拽以移动] ](https://img-blog.csdnimg.cn/direct/be10b14381d44edba0c21199408ba034.png)

为什么说这些操作只能在时间列上进行?

因为我们有的时候可以把到来的数据流就看成是一张按照时间排列好的一张表,而我们任何对于表的操作,其实都是必须在对它进行一次顺序扫描的前提下完成的。大家都知道数据流的特性之一就是一过性,某一条数据处理过去之后,将来其实不太好去访问它。当然因为 Flink中内部提供了一些状态机制,我们可以在一定程度上去弱化这个特性,但是最终还是不能超越的,限制状态不能太大。所有这些操作为什么只能在时间列上进行,因为这个时间列能够保证我们内部产生的状态不会无限的增长下去,这是一个最终的前提。

给大家的福利

零基础入门

对于从来没有接触过网络安全的同学,我们帮你准备了详细的学习成长路线图。可以说是最科学最系统的学习路线,大家跟着这个大的方向学习准没问题。

同时每个成长路线对应的板块都有配套的视频提供:

因篇幅有限,仅展示部分资料

网络安全面试题

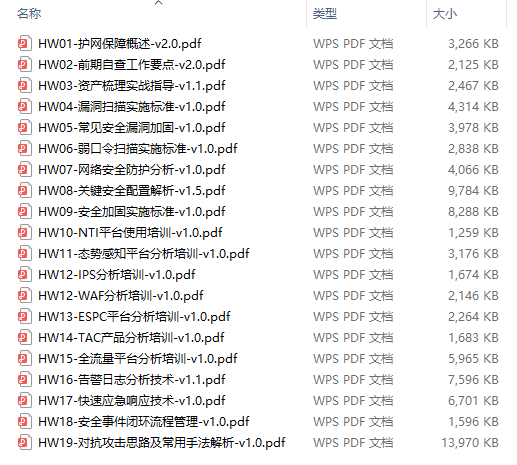

绿盟护网行动

还有大家最喜欢的黑客技术

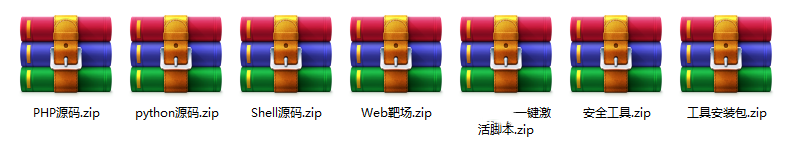

网络安全源码合集+工具包

所有资料共282G,朋友们如果有需要全套《网络安全入门+黑客进阶学习资源包》,可以扫描下方二维码领取(如遇扫码问题,可以在评论区留言领取哦)~

需要体系化学习资料的朋友,可以加我V获取:vip204888 (备注网络安全)

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!