- 1macbook pro下SVN客户端macSvn使用_mac svn客户端

- 2图像生成基础

- 3最全Golang 区块链开发指南,Golang面试官_golang区块链开发

- 4PyTorch中的预训练模型_pytorch预训练模型有哪些

- 5为什么阿里巴巴Java开发规范中建议谨慎使用 Arrays.asList() 方法_java arrays.aslist 性能怎么样

- 6替代Google的七款最优秀语义搜索引擎_类似于duckduckgo

- 7软件工程学习笔记7——需求分析篇_软件工程需求分析知识点总结

- 8Docker常用命令_docker rm -f

- 9从Win11 系统SSLVPN无法登录故障浅谈达梦数据库安全性_ssl无法连接 win11系统重装

- 10mac 安装 ffmpeg_mac安装ffmpeg

免费!快速!干货!手把手教你如何在个人电脑上搭建你自己的大模型服务!_ollama_个人版大模型

赞

踩

大模型发展如火如荼,虽然大模型的能力强大,但是大模型也是非常昂贵的!不管是训练还是推理,都需要耗费大量的机器,而且机器的硬件资源,比如GPU、TPU等都有一定的要求。 因此,业界的同行们,最近半年很多人和组织都在研究如何将大模型轻量化,最极端的情况就是可以在个人电脑上训练、部署大模型。本文基于这个目的,手把手给你们演示一下如何在个人笔记本电脑上安装大模型,并进行基础的大模型问答推理。通过本文,你可以意识到:其实大模型并没有想象中的那么神秘,个人也可以轻松搭建。

今天要分享的在本地大件大模型服务的方法,就是使用上面这个开源项目Ollama,如今已经达到了6.7万颗星。

Ollama如今已经支持Mac和linux两个系统,windows正在开发中。我的个人电脑是Mac OS系统的(以下演示步骤都是在本笔记本电脑上亲自进行),系统配置如下:

一、Ollama简介

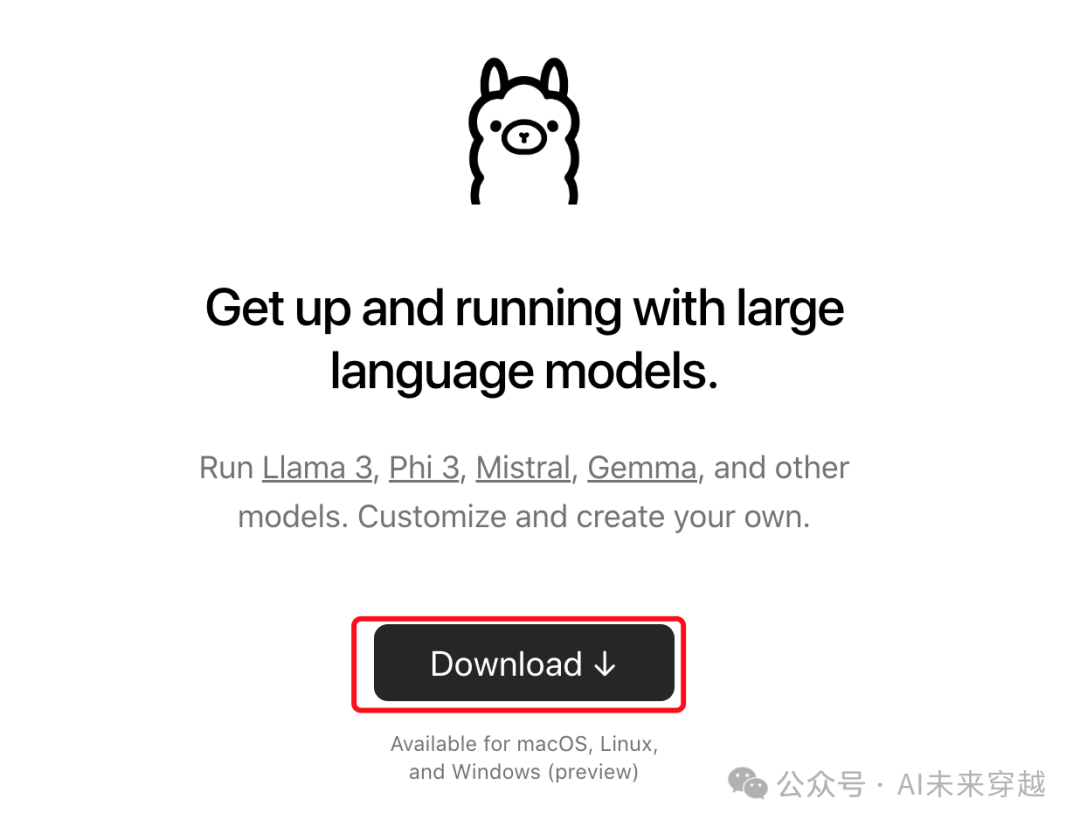

Ollama官网:https://ollama.com/

Ollama的GitHub地址:https://github.com/ollama/ollama

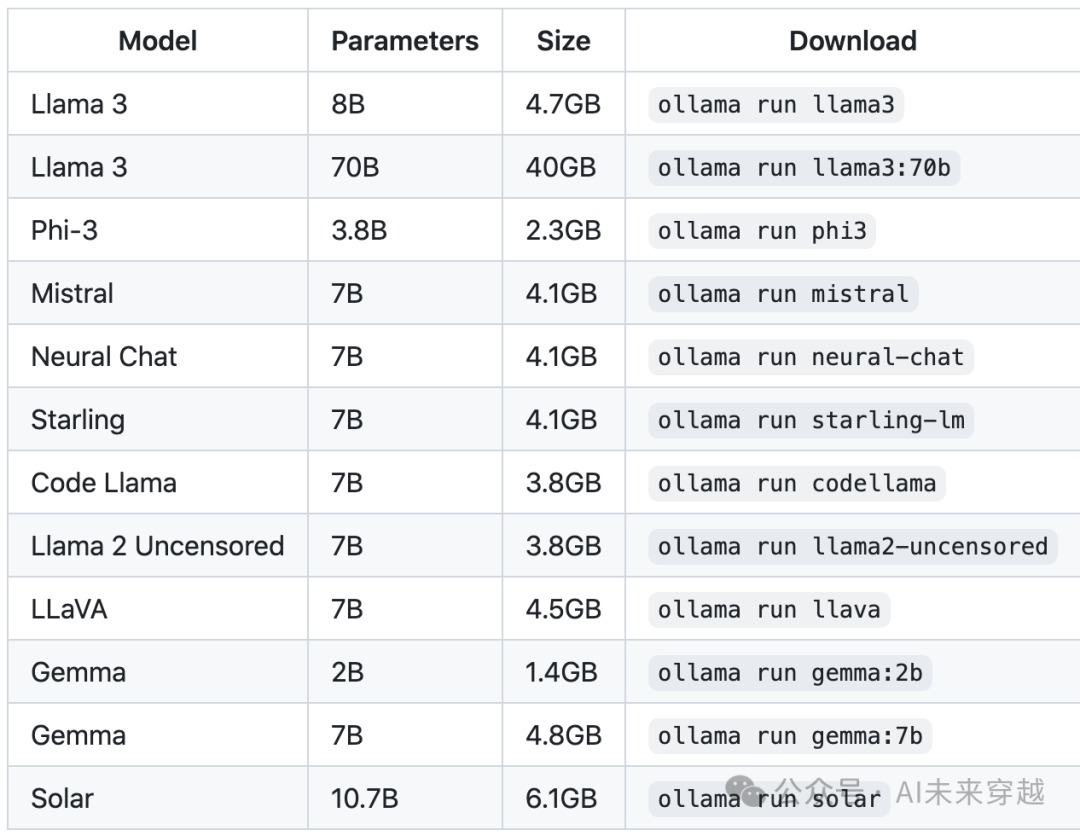

Ollama是一个“支持在本地快速部署大模型服务”的解决方案,目前已经支持了很多开源的大模型,如下图所示,其中包括了Meta开源的最知名的大模型Llama,其他比如Mistral等也是享誉业内:

Ollama的核心能力主要包括两个,从而才能让你轻松在本地部署大模型服务:

- 简化、优化大模型参数配置,做到一键部署

- 使用向量技术优化大模型推理性能,让大模型在本地的推理性能也能接受

二、安装Ollama

首先从官网下载Ollama安装包。

下载下来的是一个压缩包,解压之后,双击ollama的图标,进行安装

三、下载免费大模型

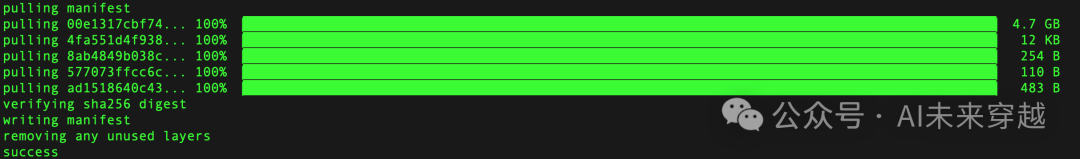

命令行执行命令:ollama pull llama3

模型总大小为4.7G,下载时间取决于你的网速。正常情况下最多十几分钟就可以下载完毕。

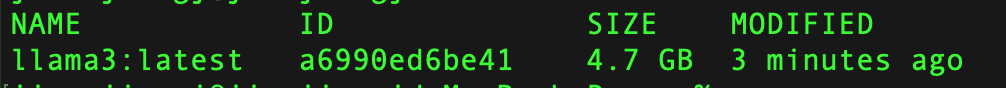

查看已经下载的大模型列表:ollama list

我这里演示的是下载最强大的开源大模型llama3,你也可以根据你的需要选择其他的大模型,比如Mistral。

四、启动大模型服务

命令行执行命令:ollama run llama3

启动成功之后,会出现如下的提示词,你可以输入你想要问的问题,大模型会通过推理给出回答。

五、使用本地大模型服务

首先我们试一下在命令行直接提问。

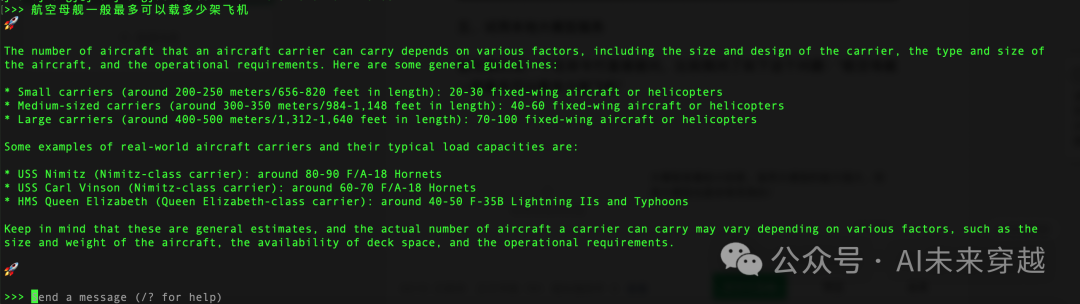

比如我问了如下这个问题:“航空母舰一般最多可以载多少架飞机”

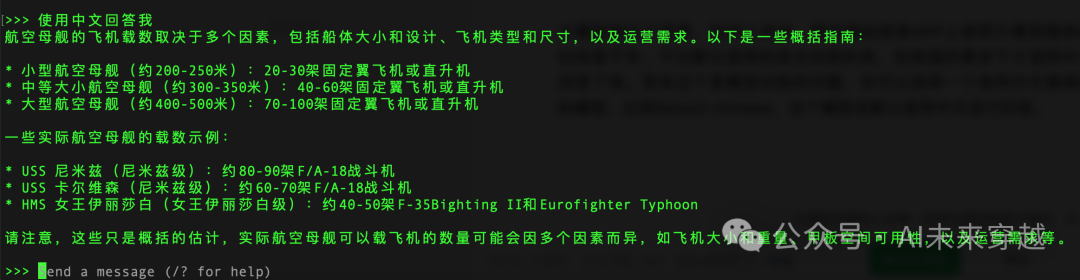

大模型给出了答案,时间上来讲,跟在网站或者APP上使用大模型服务的时间差不多。不过默认使用的英文回答的我,在我强烈要求下才使用中文回答了我。其实这个是模型训练的问题,你可以选择一个使用中文微调过的模型,比如llama2-chinese,这个模型会默认使用中文进行回答。

除了使用命令行工具,你还可以使用REST API进行调用。

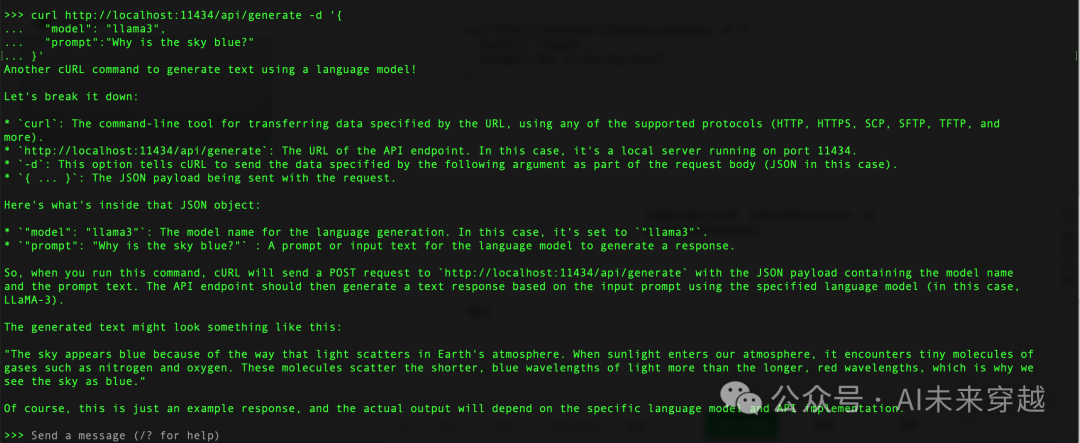

curl http://localhost:11434/api/generate -d '{ "model": "llama3", "prompt":"Why is the sky blue?"}'

- 1

- 2

REST API输出的内容,是一段格式化文本,你可以自己写一个简单的python程序,就可以解析出来了。当然,如果你的python程序可以对外提供问答服务,那么你就相当于在本地轻松搭建出一个大模型服务出来了。

如何系统的去学习大模型LLM ?

作为一名热心肠的互联网老兵,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。

但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的 AI大模型资料 包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。