热门标签

当前位置: article > 正文

scrapy爬取途牛网站旅游数据

作者:代码探险家 | 2024-07-26 12:33:24

赞

踩

爬取途牛网

描述:采取了scrapy框架对途牛网旅游数据进行了爬取,刚开始练手,所以只爬了四个字段用作测试,分别是景点名称、景点位置、景点开放时间、景点描述,爬取结果存的是json格式。

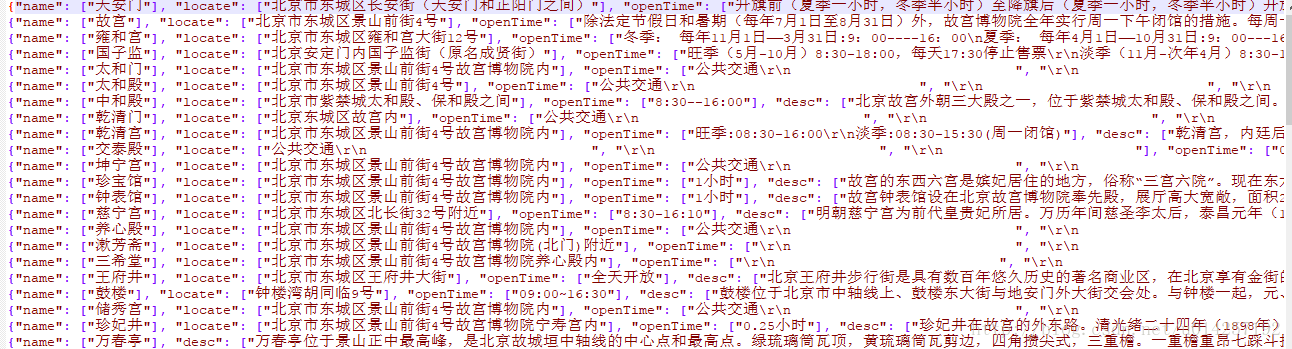

部分数据:

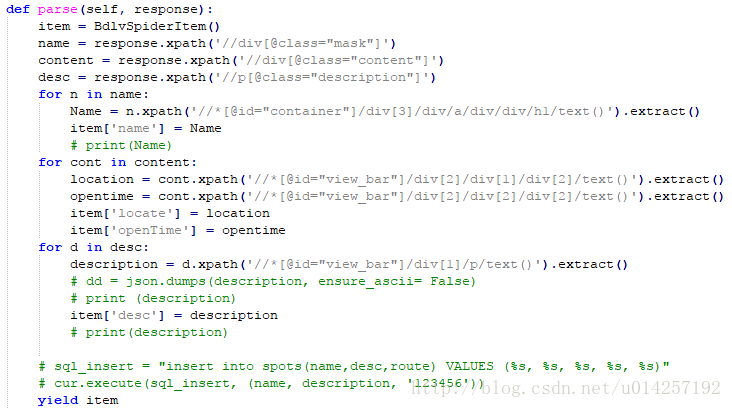

部分代码:

遇到的问题:start_urls是不能动态添加URL的,这个还需要研究,这里只是简单把所有待爬取的网址全扔进了start_urls里面,这是可行的,但是对网址的预处理就很耗时间了。然后是对汉字编码的处理,在scrapy中一开始传到json中的数据总是/uxxx类型的,这需要在pipeline.py、setting.py中都进行修改,具体修改如下:

在pipelines.py中,修改代码如下:

def __init__(self):

self.file = codecs.open('items.json', 'wb', encoding='utf-8')

#

def process_item(self, item, spider):

line = json.dumps(dict(item), ensure_ascii=False) + "\n"

self.file.write(line)

return item

#

def spider_closed(self, spider):

self.file.close()- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

在settings.py中,添加如下代码:

ITEM_PIPELINES = {

'bdlv_spider.pipelines.BdlvSpiderPipeline': 800,

}- 1

- 2

- 3

其中,BdlvSpiderPipeline是pipelines.py中的类名。

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/代码探险家/article/detail/885267

推荐阅读

相关标签