热门标签

热门文章

- 1论文后面的参考文献格式应该如何写_论文尾注参考文献格式

- 2海量数据集,机器学习、视觉、NLP、音频_312个

- 3NOIP2018普及组复赛第四题:对称二叉树_noip2018j复赛第4题

- 4linux的mount和umount指令使用_mount mnt

- 5【无套路】免费用 GPT4,为啥这些网站的聚合做的这么好?!_免费gpt4网站

- 6FastDFS文件上传详细步骤_fastdfs 上传文件

- 7程序员常用十大算法(三):动态规划算法(填表法)解决01背包问题_动态规划填表法

- 8Django-PyCharm调试_pycharm调试django

- 9富文本编辑器——UEditor的使用——基础积累

- 10Java基于Web的电子病历管理系统的实现(开题+源码)

当前位置: article > 正文

pytorch多GPU并行的问题_torch.distributed.elastic.multiprocessing.errors.c

作者:weixin_40725706 | 2024-06-13 02:32:52

赞

踩

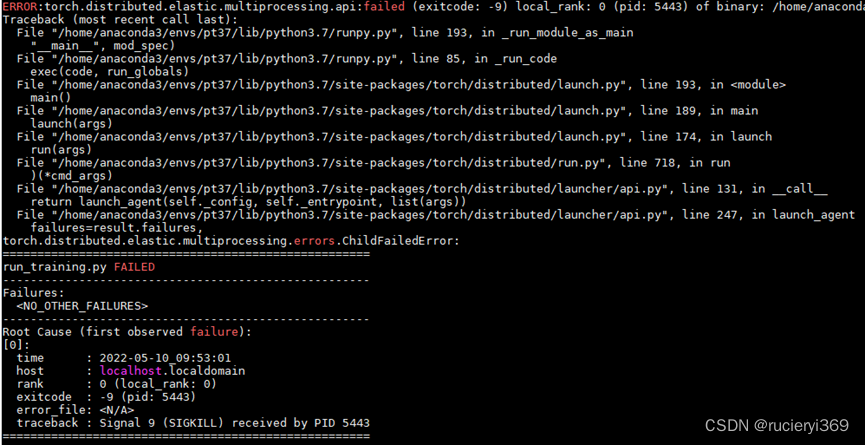

torch.distributed.elastic.multiprocessing.errors.childfailederror:

以下是在多GPU并行torch程序的时候出现的问题以及解决方案:

1.torch.distributed.elastic.multiprocessiong.erroes.ChildFailedError:

此类问题的解决方案:1.查看安装的包是否与要求的一致。

2.更改batch的大小。

3.查看其中是否有某一个gpu被占用。

2. torch.distributed.elastic.multiprocessing.api.SignalException: Process 40121 got signal: 1

在pytorch的多GPU并行时,使用nohup 会出现以上的问题,当关闭会话窗口的时候,相应的并行程序也就终止了。

一种解决方法使用tmux,tmux的使用方法:

Tmux的启动:tmux

带有名字的启动:tmux new -s 名称

退出:exit

分离会话:tmux detach

重新会话:tmux a -t 名称

Kill会话:tmux kill-session -t 名称

切换:tmux switch -t 名称

重命名:tmux rename-session -t 名称 名称1

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/weixin_40725706/article/detail/710559

推荐阅读

相关标签