热门标签

热门文章

- 1试用GitHub"狗屁不通文章生成器"写的文章!

- 2最近大火的两大AI绘图工具 Midjourney VS StableDiffusion_midjourney和stablediffusion_midjounery

- 3Python Django路由urls.py详解_admin.site.urls

- 4遥感影像几何精纠正(含详细步骤)_几何精校正

- 5word2vec 入门基础(一)

- 6java分布式事务框架_分布式事务框架(强一致性)

- 7ROS CDK魔法书:点亮博客上云新技能(JavaScript篇)_corepack is about to download

- 8GPU推理服务性能优化之路 | 得物技术_推理算力服务

- 9排序及复杂度、反转单链表_链表反转时间复杂度

- 10一刷93-贪心算法-135分发糖果(h)_siat又要进行幸运抽奖了!这次获大奖的人从n名siater中按以下规则选出: 首先,让sia

当前位置: article > 正文

在AutoDL平台上运行Meta-Llama-3-8B-Instruct模型_autodl配置llama3

作者:Li_阴宅 | 2024-08-20 01:15:05

赞

踩

autodl配置llama3

一、背景介绍

1. AutoDL平台(AutoDL算力云 | 弹性、好用、省钱。租GPU就上AutoDL):算力平台,类似阿里云,它主要提供GPU算力。通常按小时收费,显卡(RTX 3090 - 24GB显存)+ CPU(14核)+ 内存(45GB)的配置,1.58元/时。开通后,可以通过网页或者ssh链接上服务器。

2. LLaMA大模型(魔搭社区-Meta-Llama-3-8B-Instruct):Meta公司(母公司:FaceBook)发布的开源商用版本。2023年7月,Meta公司发布了人工智能模型LLaMA 2的开源商用版本,意味着大模型应用进入了“免费时代”,初创公司也能够以低廉的价格来创建类似ChatGPT这样的聊天机器人。LLaMA 2大语言模型系列是经过预训练和微调的生成式文本模型,其参数数量从70亿到700亿不等。2024年4月19日消息,Meta推出了新版本Llama人工智能模型Llama 3,希望与ChatGPT竞争。

二、创建环境

2.1 创建开发机

本节内容选择3090卡一张,创建实例。

2.2 创建运行环境

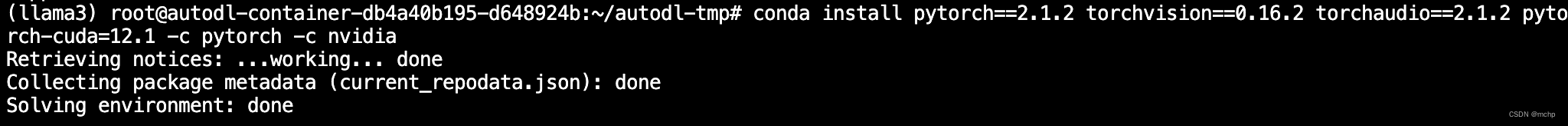

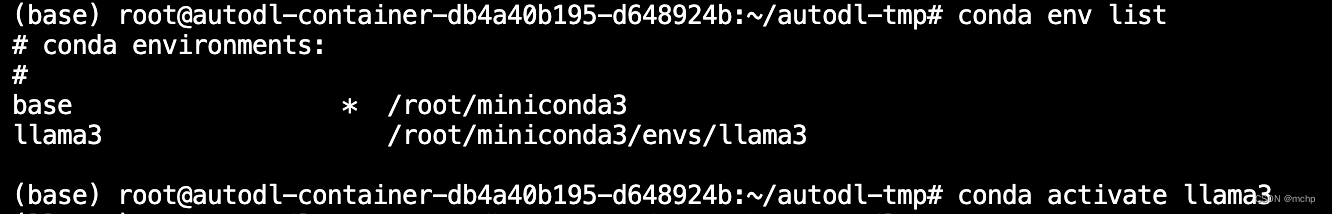

使用conda创建环境

- conda create -n llama3 python=3.10

- conda activate llama3

- conda install pytorch==2.1.2 torchvision==0.16.2 torchaudio==2.1.2 pytorch-cuda=12.1 -c pytorch -c nvidia

可以看到有了一个名称为llama3 的 conda环境

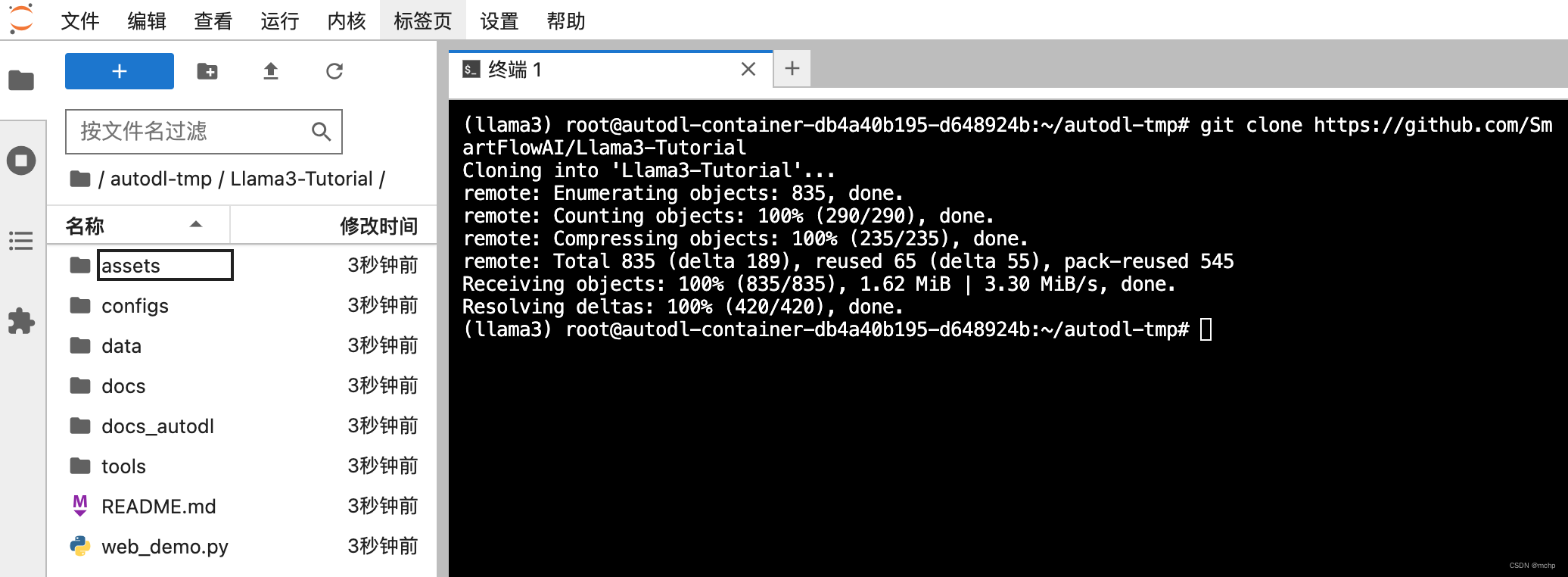

2.3 下载Llama3-Tutorial,这里有运行Llama3所需要的配置文件

git clone https://github.com/SmartFlowAI/Llama3-Tutorial

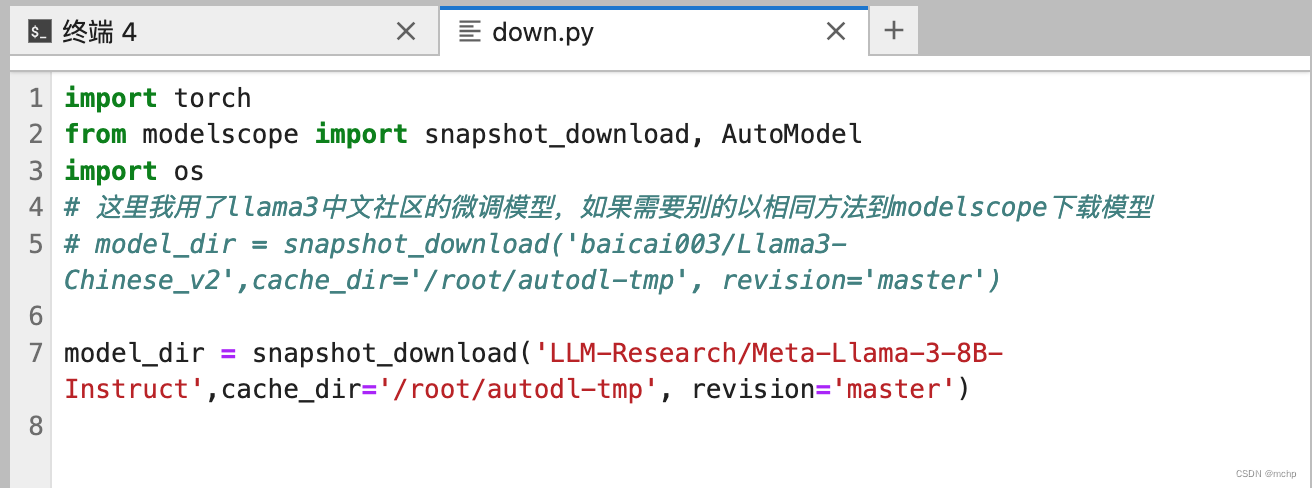

2.4 下载模型

下面是通过SDK从魔塔下载模型的方式,通过修改参数可以下载不同模型。

- import torch

- from modelscope import snapshot_download, AutoModel

- import os

- # 这里我用了llama3中文社区的微调模型,如果需要别的以相同方法到modelscope下载模型

- # model_dir = snapshot_download('baicai003/Llama3-Chinese_v2',cache_dir='/root/autodl-tmp', revision='master')

-

- model_dir = snapshot_download('LLM-Research/Meta-Llama-3-8B-Instruct',cache_dir='/root/autodl-tmp', revision='master')

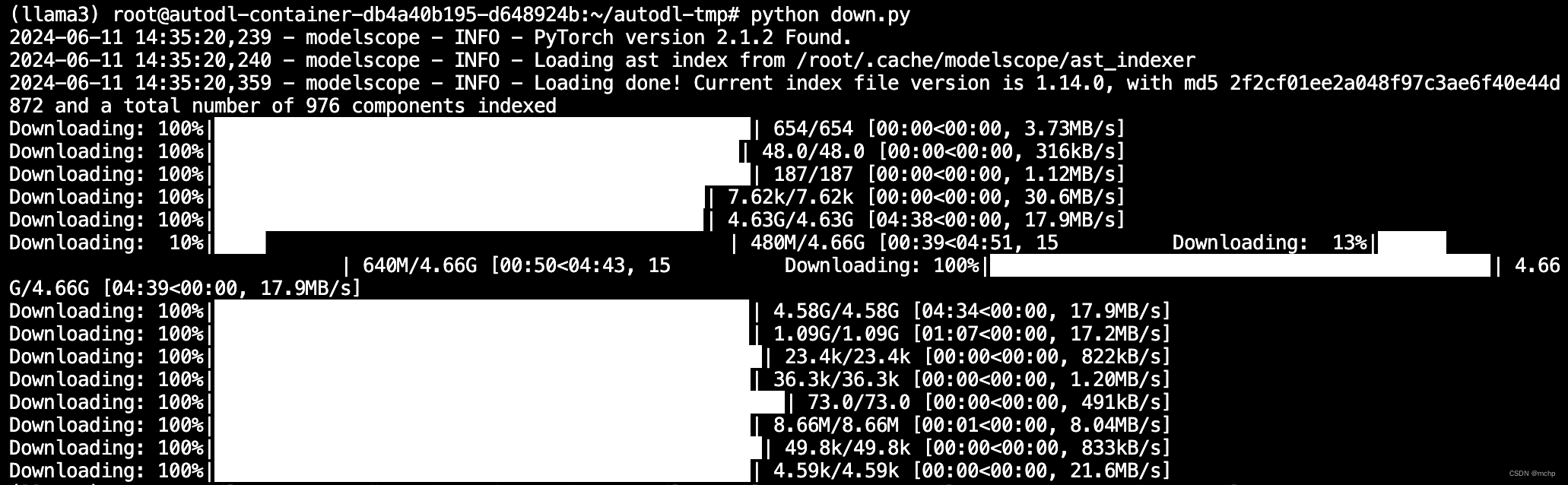

编辑down.py,并运行 python down.py。

通过软链接把下载文件映射到model文件夹。

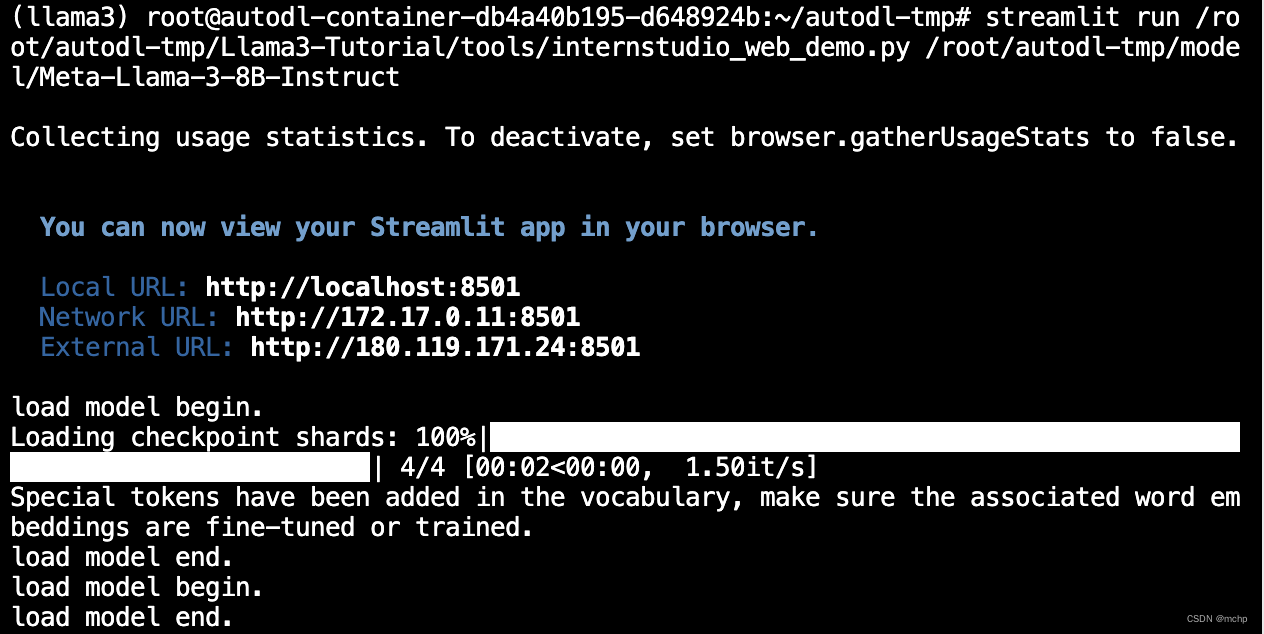

三、启动模型

- streamlit run ~/Llama3-Tutorial/tools/internstudio_web_demo.py \

- ~/model/Meta-Llama-3-8B-Instruct

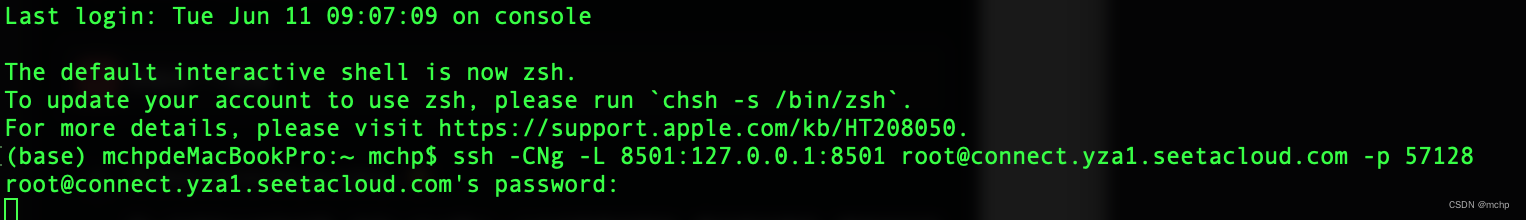

通过SSH创建隧道,把本地端口转发到远端端口。此处的端口号38374 和 密码在AutoDL页面找

ssh -CNg -L 8501:127.0.0.1:8501 root@ssh.intern-ai.org.cn -p 38374

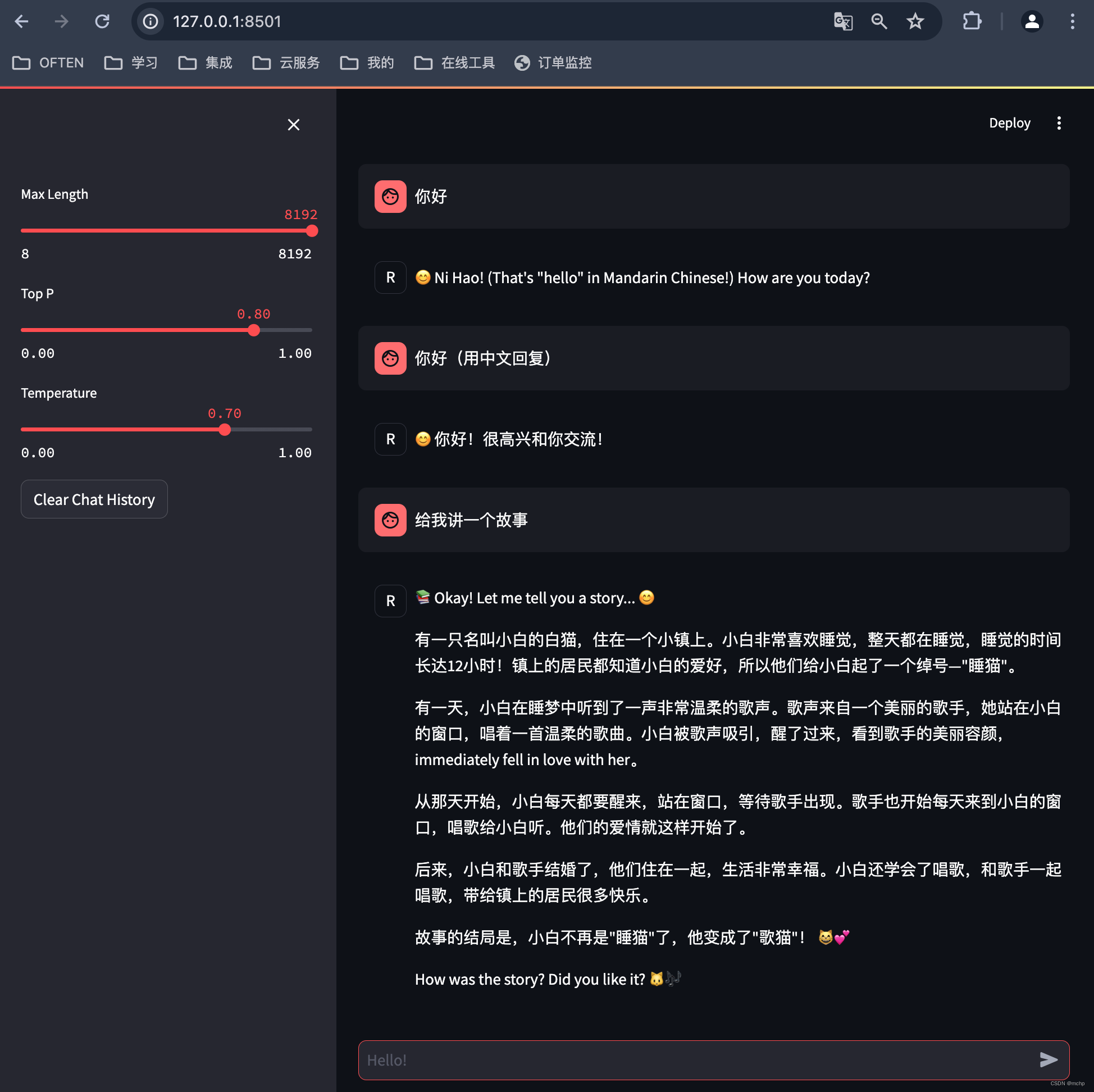

最终效果,通过本地端口访问:

完毕!

下一节介绍如何使用XTuner微调一个Llama模型。

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/Li_阴宅/article/detail/1004459

推荐阅读

相关标签