热门标签

热门文章

- 1【OpenCV C++20 学习笔记】仿射变换-warpAffine, getRotationMatrix2D

- 2并发编程系列 - ReadWriteLock

- 3【软硬件通信】ESP32 Arduino 服务端 控制舵机

- 4【Python系列】.env文件_python .env

- 5Git之删除远程分支_删除掉远程分支

- 6fastjson反序列化攻防_set property error, autocommit

- 7优化进化算法_人类进化优化算法

- 8蓝易云 - Linux服务器上安装配置GitLab的步骤。

- 9数据结构笔记--十大经典排序算法(C++)_数据结构-十大经典排序算法

- 10java中yield 和join的作用_join yeild方法的作用

当前位置: article > 正文

LLM资料大全:文本多模态大模型、垂直领域微调模型、STF数据集、训练微调部署框架、提示词工程等_多模态大模型垂类微调

作者:IT小白 | 2024-08-11 19:07:20

赞

踩

多模态大模型垂类微调

LLM资料大全:文本多模态大模型、垂直领域微调模型、STF数据集、训练微调部署框架、提示词工程等

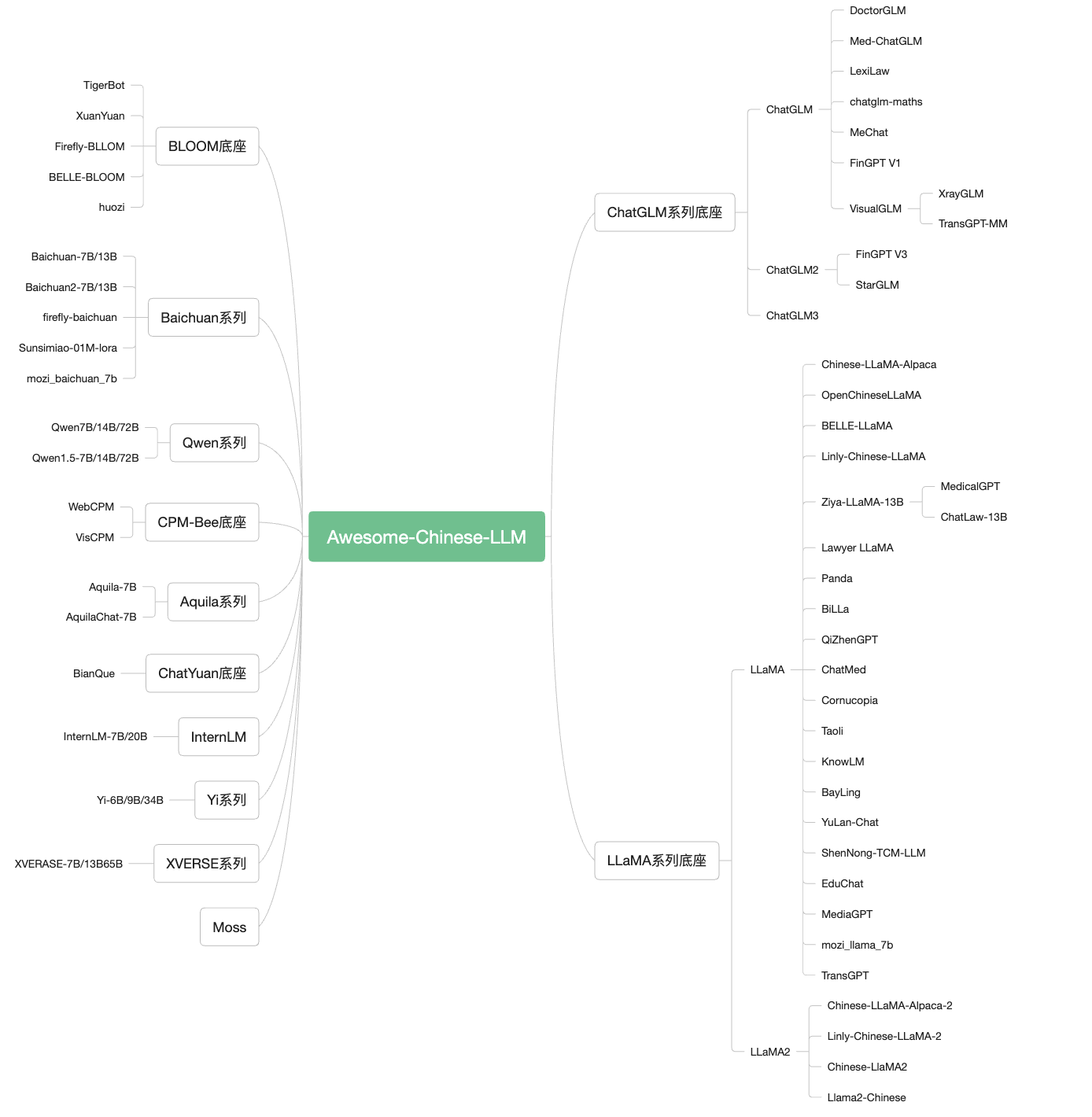

自ChatGPT为代表的大语言模型(Large Language Model, LLM)出现以后,由于其惊人的类通用人工智能(AGI)的能力,掀起了新一轮自然语言处理领域的研究和应用的浪潮。尤其是以ChatGLM、LLaMA等平民玩家都能跑起来的较小规模的LLM开源之后,业界涌现了非常多基于LLM的二次微调或应用的案例。本项目旨在收集和梳理中文LLM相关的开源模型、应用、数据集及教程等资料,目前收录的资源已达100+个!

常见底座模型细节概览:

| 底座 | 包含模型 | 模型参数大小 | 训练token数 | 训练最大长度 | 是否可商用 |

|---|---|---|---|---|---|

| ChatGLM | ChatGLM/2/3 Base&Chat | 6B | 1T/1.4 | 2K/32K | 可商用 |

| LLaMA | LLaMA/2/3 Base&Chat | 7B/8B/13B/33B/70B | 1T/2T | 2k/4k | 部分可商用 |

| Baichuan | Baichuan/2 Base&Chat | 7B/13B | 1.2T/1.4T | 4k | 可商用 |

| Qwen |

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/IT小白/article/detail/965622

推荐阅读

相关标签