- 1电脑自带录屏在哪?电脑录屏,4个详细方法

- 2Openai神作Dalle2理论和代码复现_dalle2复现代码

- 3第4节:Neo4j数据库实例_创建neo4j数据库实例

- 4Python-Django 静态文件的引入和配置(五)_static怎么导入vscode

- 5【网络】网络层IP报头的格式、网段划分、子网掩码、路由、数据链路层、MAC地址、ARP协议。_ip头部格式

- 6微信小程序电影推荐demo实战开发小结(附源码及思维导图) ... ..._微信小程序微电影详情代码

- 7【Java数据结构】Map和Set的使用_set

- 8SF Symbols 2在哪里下载 (SwiftUI 教程)_sf symbols 下载

- 9【开源社区建设】开源项目贡献者指南_fastbee 使用讲解

- 10textrank4zh提取文本关键词和内容摘要_tr4提取摘要

邱锡鹏 神经网络与深度学习课程【九】——循环神经网络2和3

赞

踩

应用到机器学习

序列到类别 :

包含h_1、h_2、h_3....h_t所有的历史信息也可以按照取平均值的方法 获取对应类别

应用:情感分类

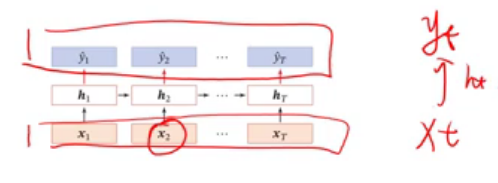

同步的序列到序列模式:

输入一个x_t对应一个y_t 一个输入加上之前的h_t对应一个输出

应用:1.中文分词 这类问题变成序列标注问题 S代表单个词 B代表一个词的开始 E代表一个词的结束

2.信息抽取 Information Extraction IE 从无结构的文本中抽取结构化的信息 形成知识

异步的序列到序列模式:

可以一分为二来看,输入部分可以看作Encoder,输出部分看作Decoder ,Decoder参数输入包括了h_t+1 和上一个输出的结果y_1 被成为自回归模型

应用:机器翻译

参数学习

定义损失函数

梯度:随时间反向传播算法

梯度消失/爆炸

长程依赖问题

长程依赖改进方法 :1.循环边改为线性依赖关系 但是模型能力变弱 2.增加非线性 类似于残差网络

主要改进模型:长-短期-记忆神经网络 LSTM

i_t 是影响新输入数据的比例能够进入c_t多少,f_t是影响上一个c_t-1的遗忘比例剩余的进入中,o_t是影响输出的c_t的比例进入最终的h_t中

LSTM-各种变体 1.没有遗忘门 2.耦合输入门和遗忘门 3.peephole连接

GRU 主要是更新门z_t和重置门r_t

深层模型

堆叠循环神经网络:当某一时刻 某个隐状态来讲 数据要么来自同一层的前一个时刻 要么来自同一个时刻的下一层

其他加深方法:1.某层的隐时刻可以是来自下一层所有的时刻的隐状态 2.来自同一时刻的所有层的所有的隐时刻

双向循环神经网络 双向建模 既可以拿到左边的信息也可以拿到右边的信息 做决策做的更准

循环神经网络扩展到图网络

处理的数据为序列,但是也有树结构,更为复杂一些就是图

树结构 例如程序语言的句法结构 NLP的语法结构

递归神经网络 Recursive Neural Network 在一个有向无循环图上共享一个组合函数

退化为循环神经网络

递归神经网络可以直接对短语进行表示,建立语法树

图网络 实际应用中,很多的数据都是图结构的,比如知识图谱、社交网络、分子网络等。而前馈网络和循环网络很难处理图结构的数据

例子:

图的更新 e_k为边 v_i为结点 u是全局网络 先更新e_k 再根据e_k的边更新 v_i结点 最后再更新u 之后就是循环更新

循环神经网络的应用:

语言模型 自然语言理解 ---> 一个句子的可能性/合理性 通过合理性/可能性进行打分 可以把这些都看成概率

模型

应用:写歌、作诗、传统统计机器翻译

基于序列到序列的机器翻译 异步的RNN 是很方便的

看图说话

写字

对话系统

总结: