热门标签

热门文章

- 1PMON环境配置(龙芯,亲测成功1)

- 2C# 正则表达式详解(学习心得 25)_正则 c# \1+

- 3江苏移动CM101s-MV100-EMMC- M8233_强刷固件包_m8233线刷固件

- 4Photoshop史上最强更新,动动手指就能让AI替你修图_ps里ai怎么修图

- 5Leaflet中多边形Polygon事件监听失效的可能原因_leaflet 多边形点击事件

- 6微信小程序学习笔记(3)——代码结构_compiletype

- 7springboot aop 切到service层,不生效_spring写了@afterreturning切点不生效

- 8鸿蒙应用开发之媒体(相机)_鸿蒙相机api

- 9android的system下的目录以及根目录下的文件夹_system或product目录

- 10在mac OS安装Android SDK教程_mac android-sdk-macosx

当前位置: article > 正文

机器学习-线性回归

作者:Cpp五条 | 2024-03-18 07:11:11

赞

踩

机器学习-线性回归

实现原理

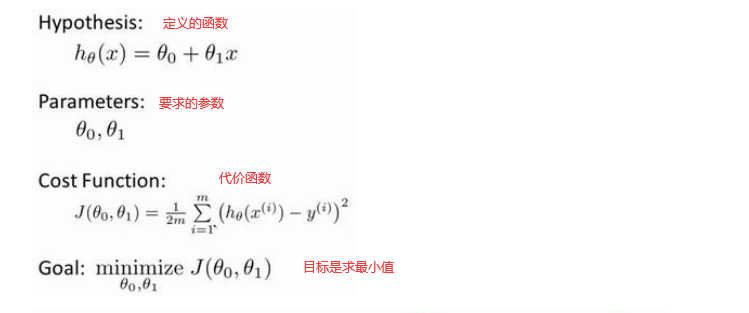

假设:我们可以用一个函数来模仿,现在数据的走势,比如以下的数据,假设我们有一个函数可以拟合,一下数据(红线).

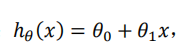

我们先定义一个简单的函数,比如说是一元线性回归:

h: 表示我们预测的值

x: 变量

而我要求的就是这些参数.

但是如何能够准确的让我们模拟的函数准确呢?

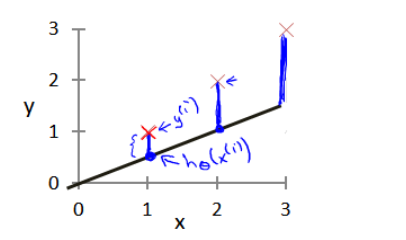

我们再这里就利用了数学上的平方误差公式,然后利用方差公式,在求平方误差值最小的时候,我们的参数就是当前好的参数.

所以这里就引出了代价函数

我们看红色X (真实值)距离我们自己画的函数有多远,尽量的让自己画的函数,能够挨着,真实值为最近.

(如何实现它能够尽量的接近呢? 我们就定义代价函数 – 基本的原理也是 真实值 与我们预测值的距离 之和 的平均值 ,)

注意: 上面之所以多除2 是因为后面比较好计算.

然后我们是怎么计算到这些值的呢?

就是求我们的代价函数最小值.

按数学的逻辑来说,我们就是要对我们的代价函数求导,要找到它的最小值,但是计算机如何做呢?

梯度下架

之前我们说了,要求代价函数的最小值,我们如何求呢?

现在 就可以说了 ,我们是利用梯度下降算法来求到代价函数的最小值.

我们对代价函数求偏导,就能够得到梯度方向,然后就可以选择学习速率

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/Cpp五条/article/detail/261259

推荐阅读

相关标签

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。