- 1迟到的2022年终总结

- 2① - 前端三剑客之基础入门篇 - 千字文认知前端开发_html大前端

- 3java从零基础到项目实战,两年Java开发经验_java自学项目经验

- 4解决adb的adb server version (32) doesn't match this client (36)或(35)_error: could not install *smartsocket* listener: a

- 5实验四、零比特插入《计算机网络》_零比特插入删除主要解决什么问题

- 6使用TabLayout和ViewPager实现左右滑动选项卡_android tablayout 判断左右滑动

- 7使用Python绘制科赫雪花曲线_科赫雪花绘制 python

- 8实时分析、融合统一及云原生,现代化数据仓库未来发展必经之路|专访飞轮科技 CEO 马如悦_飞轮 数据湖

- 9【opencv】示例-ela.cpp JPEG图像的错误等级分析(ELA) 通过分析图像压缩后的差异来检测图像是否被篡改过...

- 10语义分割论文翻译:Large Kernel Matters —— Improve Semantic Segmentation by Global Convolutional Network

ComfyUI的节点_comfyui vae解码节点

赞

踩

本文目的

(1)记录基础工作流节点功能

(2)测试参数表现(部分)

使用大模型:SDXL --StableDiffusion,内置有clip和vae模型

节点

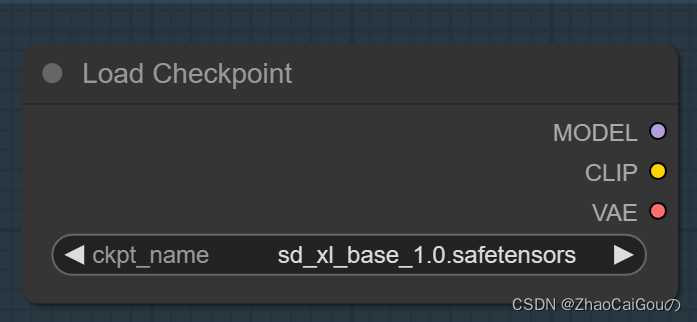

load checkpoint

输出:

model:对潜空间模型去噪

clip:对prompt进行编码

vae:对潜空间图像编码+解码

clip set last layer

clip模型对prompt进行编码,stop_at_clip_layer控制选择我们需要的一层编码信息,引导模型扩散

clip text encode(prompt)节点

输入正/反向提示词

ksampler

对潜空间噪声图像逐步去噪

seed:噪声生成使用的随机数种子 **种子数有上限**

control_after_generate:产生种子后的控制方式,具体有:fixed(固定种子)、increment(每次+1)、decrement(每次-1)、randomize(随机)

steps:去噪步长

cfg:prompt对最终结果会产生多大的影响(默认就差不多,看需求)

sampler_name:不同的采样器(默认的就差不多)

scheduler:不同的调度器(默认的就差不多)

denoise:去噪幅度/重绘幅度(最大也就1, 默认的就是1, 蛮不错的)

--denoise = 0:不添加噪声

--denoise = 1:完全随机噪声

empty latent image

生成纯噪声的潜空间图像,并设置比例

【注】SD1.0 SD1.5常用512*512,SDXL SD turbo等常用1024*1024

vae decode

将潜空间图像解码到像素级图像

注:samples接收的是经过ksampler采样处理后的潜空间图像

大部分ckpt自带vae,直接用ckpt输出的vae即可

preview image

预览图片啦

vae decode(tiled)

同vae decode, 增加了控制瓦片大小的参数(pic 1024, tile_size 512, 分成了四个)

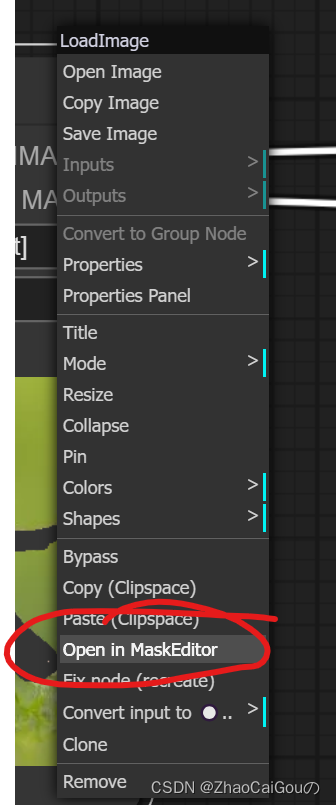

load image

加载图片, comfyui源图放在工程文件的input路径

图片右键菜单,选择 open in MaskEditor

invert image

颜色反转

pad image for outpainting

原图上下左右加边框,蒙版部分加羽化参数

输出image和mask, mask配合mask to image 节点,将mask转为图像

convert mask to image

将mask转为图像

load vae

指定vae模型

vae encode(for inpainting)

通过指定的vae模型对图像进行编码,添加mask

upscale image

通过指定基础算法对图像进行调整

(算法一般图片影响不大,看需求)

测试参数表现(部分)

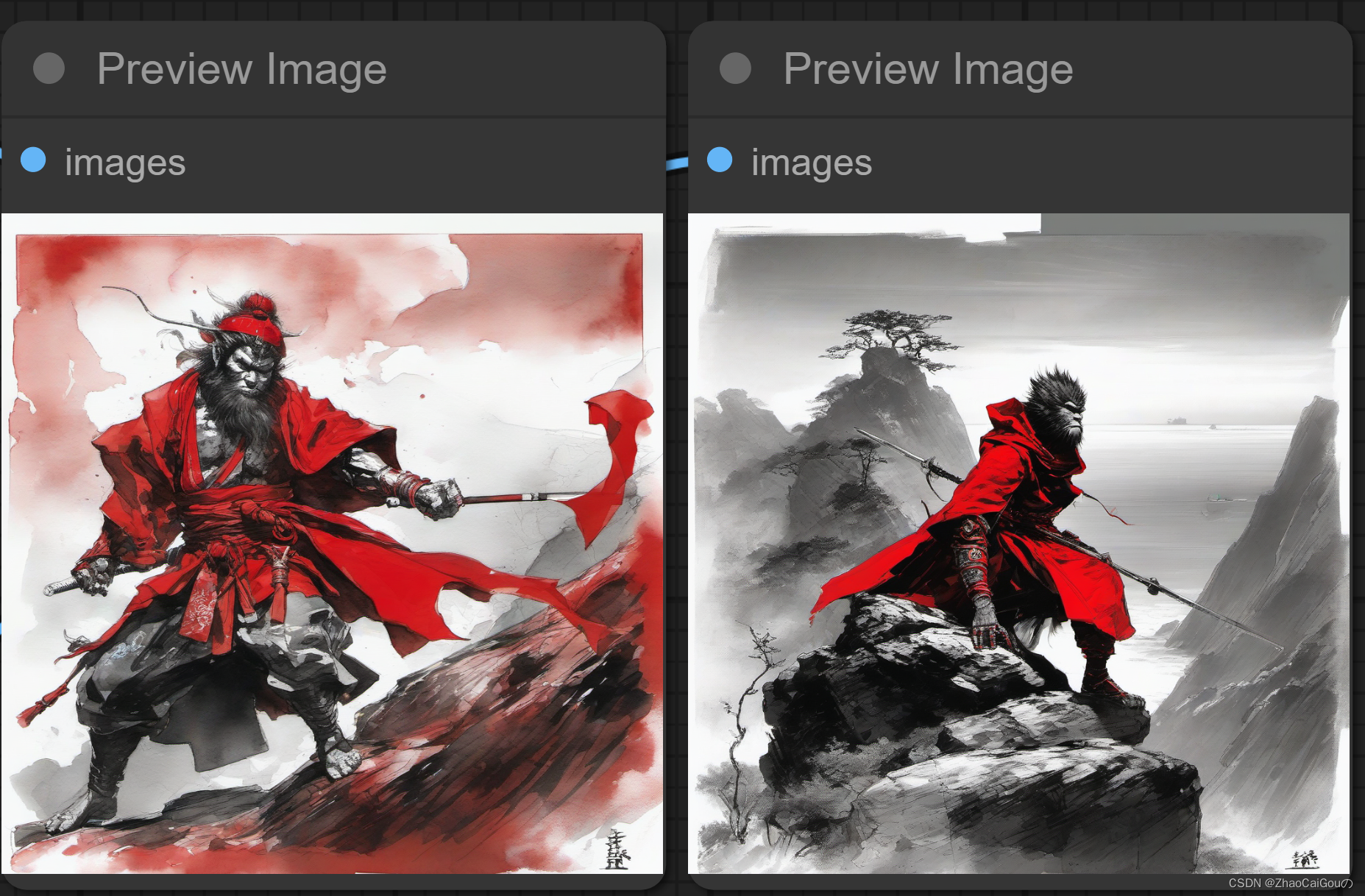

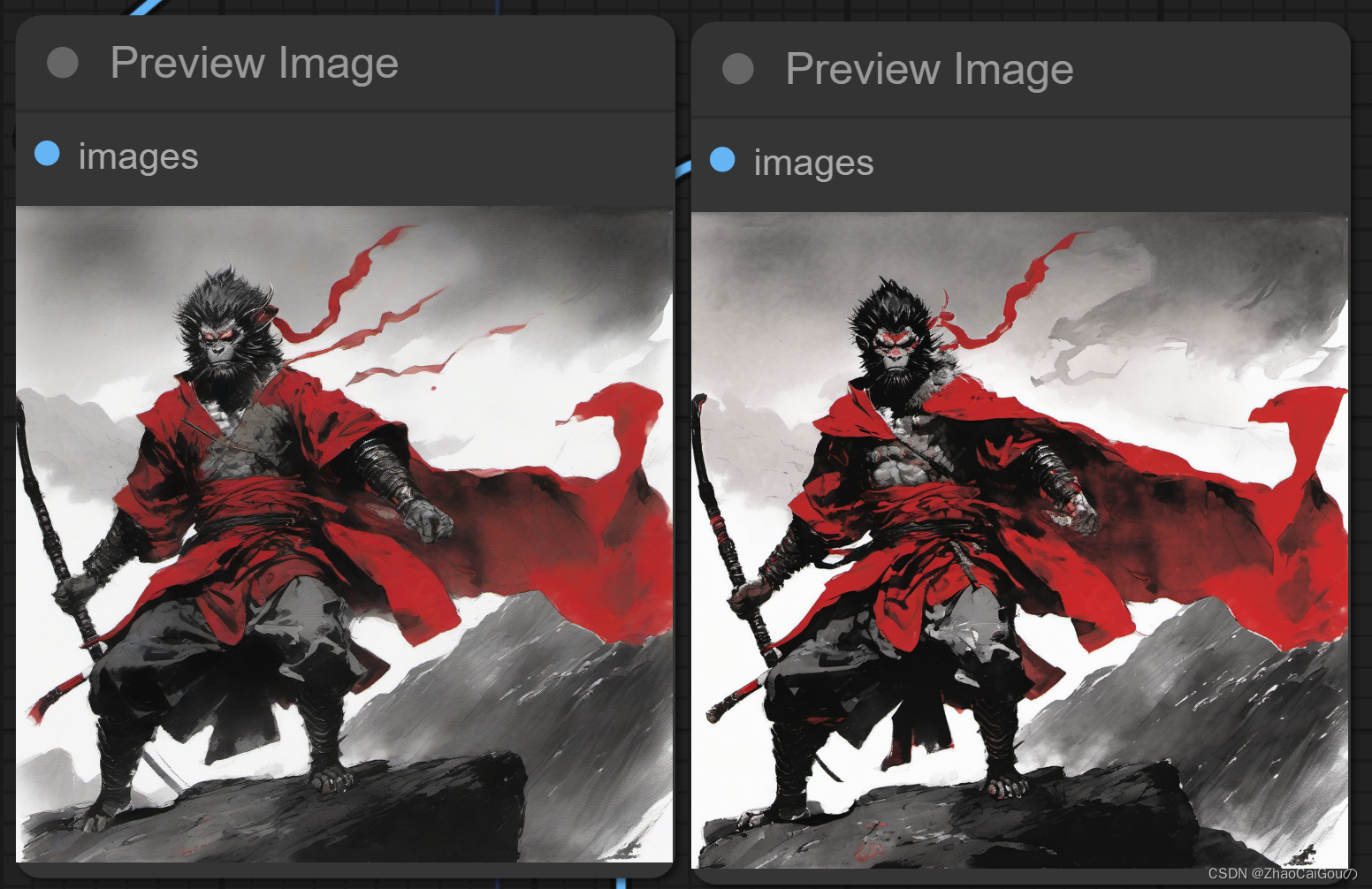

clip set last layer

(1)控制stop_at_clip_layer = -1 / -2

(2)ksampler 固定种子且种子数相同

输出图片不同(左-1, 右-2)

(左-5 右-8)

(左-5 右-8)

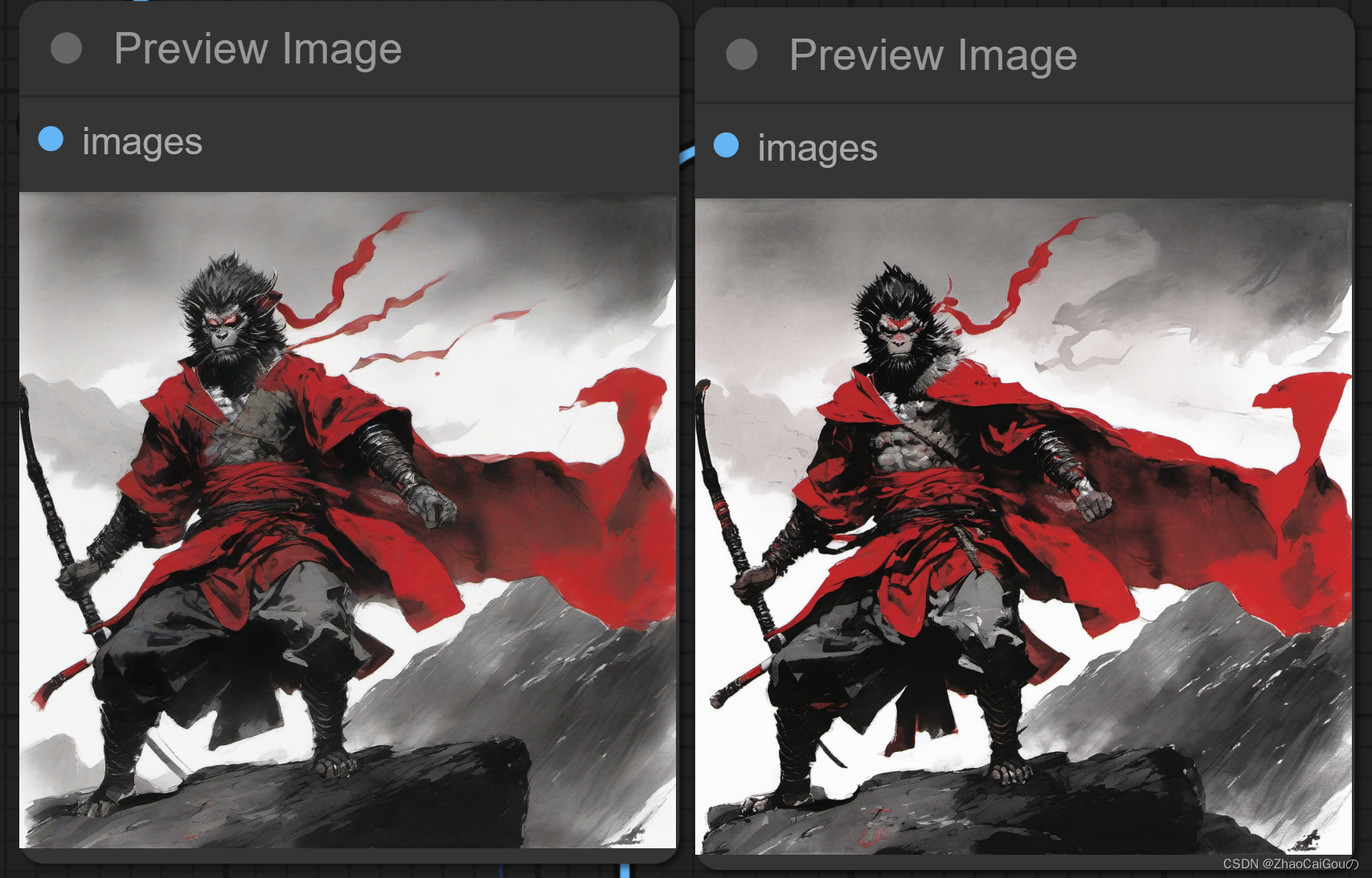

ksampler

种子太随机了,感觉推荐的就不错,测试了一下步长,有限范围内会增加一些细节(但时间变久),看具体需求改吧

输出图片(左:steps 20; 右:steps 200)

(左:steps 20; 右:steps 1000)

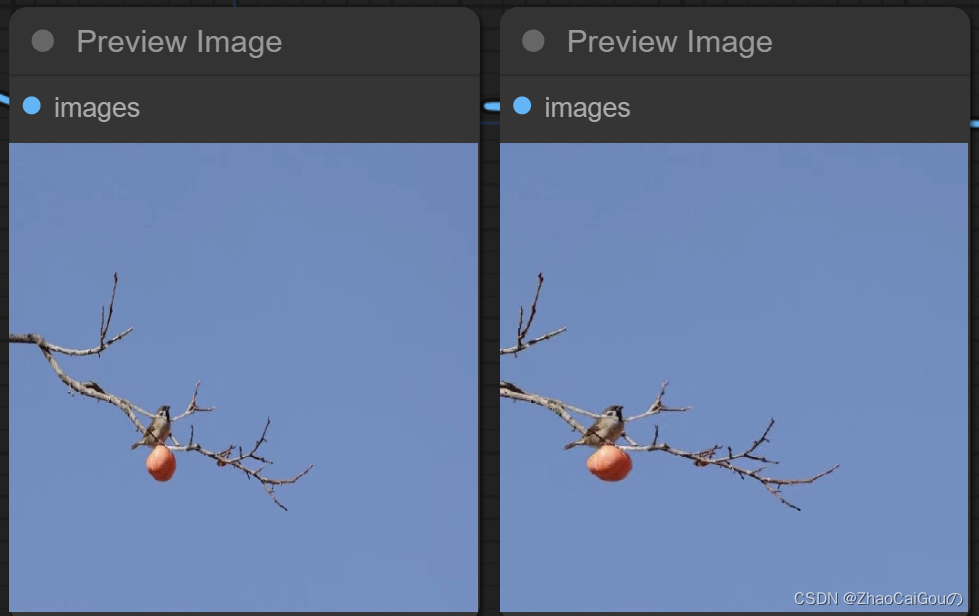

upscale image

1、crop 裁剪测试(左 disable,右 center,均使用nearest-exact算法)

invert image

反差色效果

pad image for outpainting

黄色即扩充的边框(左),配合添加vae 编码解码,修改边框(右)

----记录,后续继续补充2.0