热门标签

热门文章

- 1人工智能与情绪识别:未来的关键技术

- 2UDP端口连不上的情况

- 3最全的java对接微信小程序客服功能实现(包含自动回复文本消息、图片消息,进入人工客服)_java实现连接微信客服的方法

- 4虚拟机网段与宿主机的网段不匹配造成xshell连接不上_复制虚拟机ip和本地ip网段不一致,xshell连不上

- 5【2024美赛】C题 Problem C: Momentum in Tennis网球运动中的势头 网球问题一python代码_2024美赛c 题目

- 6MMSegmentation自定义数据集

- 7YOLOv8改进:构建新的C2f_RepGhost模块,针对Ghost进行重参数化,速度,mAP双提高!_repghostconv

- 8白天研究生系列:炼丹专题第三集《本地部署大语言模型保姆级教程——以ChatGLM-6B为例》_chatglm4-6b

- 9轻易云AI:引领企业数智化转型提升企业AI效率_小汤ai健康百科智能搜索工具

- 10为什么大模型计算的时候只会利用KVcache来存放KV矩阵,Q矩阵每次不一样?_kv缓存技术为什么不能用在训练阶段

当前位置: article > 正文

注意力机制(Attention mechanism)_自注意力机制dk

作者:从前慢现在也慢 | 2024-04-01 03:08:16

赞

踩

自注意力机制dk

自注意力机制(self-attention)

首先,其核心思想为:

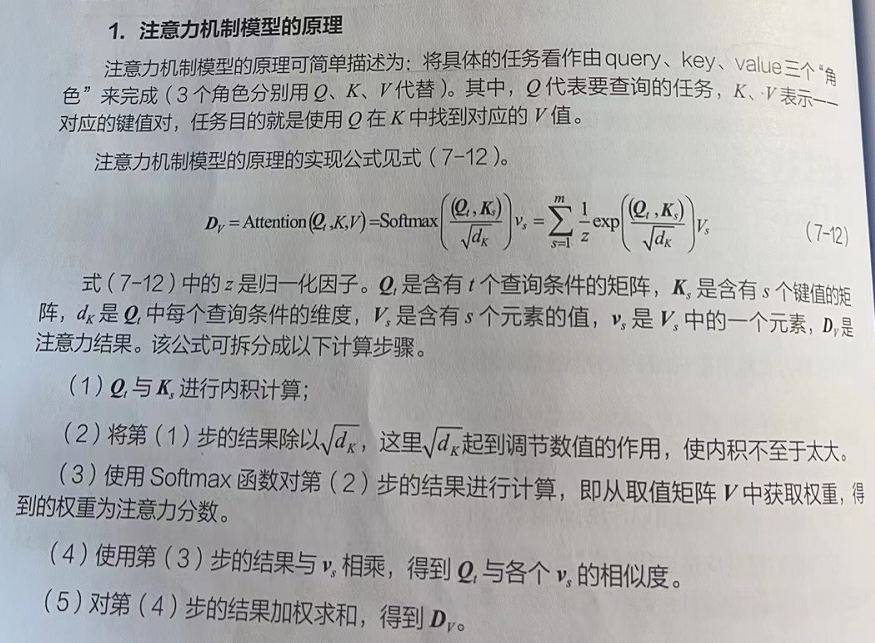

其中,Q为query, ,即查询、要查询的信息

K为key, ,即索引、被查询的向量

V为value, ,即值、查询到的内容

dk代表k的维度,除以k的维度的平方根,使训练时的梯度保持稳定

Q,K,V都是输入x经过经过线性变换得到的,和它们分别相乘的三个矩阵W是通过学习得到的矩阵,使用这样的线性变换可以提高的模型的拟合能力

举一个例子

有一个渣男,他有 n 个备胎,他想要从自己的备胎里寻找最符合自己期望的,好分配注意力和管理时间

用 Q 表示择偶标准,K表示自身条件,V表示被匹配到的备胎

所以不论是渣男,还是备胎,都有着自己的一套Q,K,V

那么,当渣男开始筛选备胎时,肯定是备胎条件与渣男的择偶标准相符合时比较好,也就是备胎的 K 与渣男的 Q 相似度更高时

对于两个向量点乘的几何意义:向量A与向量B的点乘,也就是A在B向量上的投影,所以点乘的大小可以表示A与B向量的相似度。当两个向量垂直时,我们知道它们点乘的结果为0,说明这两个向量没有一点相关性,所以同样,当两个向量点乘的结果越大时,说明两个向量的相似度就越高

再看向 ,矩阵Q与矩阵K的转置相乘,相当于Q的每一行和K的每一行进行点乘,也就是每个行向量的相似度,然后使用

函数对结果进行归一化,也就是让所有元素的和为1,我们就得到了一个权重矩阵,接下来用得到的权重矩阵给匹配到的备胎加权,也就是将权重矩阵与V相乘,渣男就知道该对每个备胎付出多少注意力了

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/从前慢现在也慢/article/detail/347160?site

推荐阅读

相关标签